搜索到

296

篇与

的结果

-

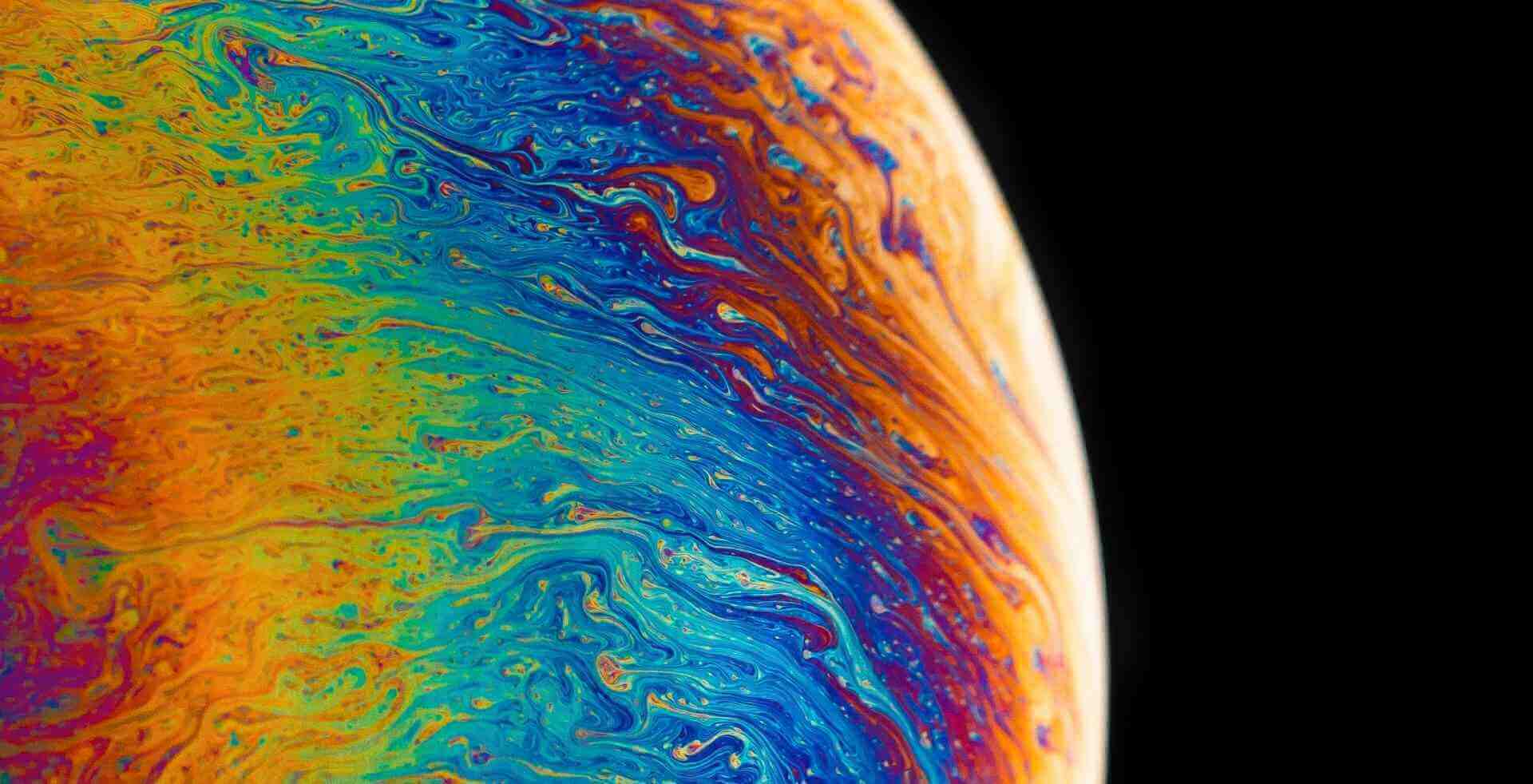

洛雪音乐下载安装与使用全教程:2026最新音源配置(附图文详解) 博主最近用PC比较多,之前用的刘明野工具箱被河蟹了,也不想花钱买会员,需要寻找一款能在电脑上无阻碍免费听歌的软件,于是找到的洛雪。一、关于洛雪洛雪音乐是一款免费音乐播放器,它的核心作用是聚合全网音乐资源,让用户能一站式收听、缓存各类歌曲,无需在多个平台间切换。洛雪音乐的界面简洁直观,没有复杂操作,新手小白打开后就能轻松上手搜索和播放,完全不用花费时间研究使用方法,专注于享受音乐本身。洛雪音乐最大的亮点就是完全免费开源,无广告、无会员付费墙,全程不会有弹窗干扰。洛雪音乐支持 FLAC、APE 等无损格式播放与缓存,最高可达 192kHz/24bit 高清音质,内置音频 DSP 和 10 波段均衡器,可调节高低音增强效果,兼顾普通用户和音乐爱好者需求。和其它播放器相比,洛雪音乐没有功能缩水,反而支持多 CDN 加速,热歌秒加载,离线缓存后无网也能播放,同时注重隐私保护,一键清空搜索历史,兼顾实用性和安全性,是兼顾各类用户需求的高性价比选择。更贴心的是洛雪音乐的无账号设计,不收集用户数据,同时支持批量下载和断点续传,网络波动时也不会重复浪费流量。二、洛雪音乐的下载与安装1下载洛雪音乐下载地址: 洛雪音乐安装包下载地址 最新版的PC版本是2.12:电梯直达最新版移动版本是1.8.1:电梯直达1桌面版以 .dmg 结尾的文件适用于 macOS 系统。 以 .deb/.rpm/.AppImage/.pacman 结尾的文件适用于 Linux 系统。 带 win_ 或 Setup 的文件适用于 Windows 系统。 以 Setup.exe 结尾的文件为安装版,具备「自动更新」功能,软件启动时会自动检测并安装更新。 但若你所在网络访问 GitHub 较慢,则可能会更新失败,这时需要手动下载安装包覆盖安装。 以 green.7z 结尾的文件为免安装版,解压后可直接运行里面的 lx-music-desktop.exe,但无法自动更新。 带 x64 的文件适用于 64 位操作系统,x86 适用于 32 位操作系统,arm64 适用于较新的 Arm 机器。 2移动版以 .apk 结尾的文件适用于 Android 系统。 建议优先下载 arm64-v8a 安装包,若无法安装再下载 universal 安装包。 另外还有 armeabi-v7a/x86_64 等安装包,若有需要可自行下载。 版本号包含 sl 的安装包为「墨·状态栏」特别版,详情看状态栏歌词。 universal 安装包的内部版本号总是低于单架构安装包的内部版本(包括跨版本)。安装新版本时,如果遇到版本号太低的提示,请尝试使用其他单架构安装包。 目前没有计划支持 iOS 和 HarmonyOS NEXT。 2安装洛雪音乐1) 下载安装包,双击 lx-music-desktop-v2.12.0.exe 启动安装:2) 点击 “我同意”:3) 点击 “下一步”:4) 系统默认安装到 C 盘,这里强烈建议手动修改到其他盘(非系统盘),点击 “安装”:5) 等待进度条加载到 100%:6) 点击 “完成”:7) 出现下图所示界面,安装完成:三、使用洛雪音乐1) 点击 “设置”:2) 点击 “自定义源管理”:3) 点击 “在线导入”:4) 复制 https://ghproxy.net/https://raw.githubusercontent.com/pdone/lx-music-source/main/flower/latest.js 或者 https://tt.tenmeng.com/moonue/js/yecao202412.js ,粘贴到方框内,点击 “导入”:5) 导入完成后,关闭窗口:6) 勾选导入的源,就可以使用了:四、洛雪音乐常见问题1) 无法播放/下载:切音源 → 清缓存 → 换网络 → 关防火墙 → 升最新版。2) 桌面歌词/列表缺失:洛雪定位 “查歌器”,非完整播放器,可外接 foobar 使用。3) 歌单同步失败:同一局域网 → 实验性同步 → 数据明文勿在公网用。4) 音源导入失败:路径无中文 → 文件权限→ 客户端 1.6.0+ →重启生效。

洛雪音乐下载安装与使用全教程:2026最新音源配置(附图文详解) 博主最近用PC比较多,之前用的刘明野工具箱被河蟹了,也不想花钱买会员,需要寻找一款能在电脑上无阻碍免费听歌的软件,于是找到的洛雪。一、关于洛雪洛雪音乐是一款免费音乐播放器,它的核心作用是聚合全网音乐资源,让用户能一站式收听、缓存各类歌曲,无需在多个平台间切换。洛雪音乐的界面简洁直观,没有复杂操作,新手小白打开后就能轻松上手搜索和播放,完全不用花费时间研究使用方法,专注于享受音乐本身。洛雪音乐最大的亮点就是完全免费开源,无广告、无会员付费墙,全程不会有弹窗干扰。洛雪音乐支持 FLAC、APE 等无损格式播放与缓存,最高可达 192kHz/24bit 高清音质,内置音频 DSP 和 10 波段均衡器,可调节高低音增强效果,兼顾普通用户和音乐爱好者需求。和其它播放器相比,洛雪音乐没有功能缩水,反而支持多 CDN 加速,热歌秒加载,离线缓存后无网也能播放,同时注重隐私保护,一键清空搜索历史,兼顾实用性和安全性,是兼顾各类用户需求的高性价比选择。更贴心的是洛雪音乐的无账号设计,不收集用户数据,同时支持批量下载和断点续传,网络波动时也不会重复浪费流量。二、洛雪音乐的下载与安装1下载洛雪音乐下载地址: 洛雪音乐安装包下载地址 最新版的PC版本是2.12:电梯直达最新版移动版本是1.8.1:电梯直达1桌面版以 .dmg 结尾的文件适用于 macOS 系统。 以 .deb/.rpm/.AppImage/.pacman 结尾的文件适用于 Linux 系统。 带 win_ 或 Setup 的文件适用于 Windows 系统。 以 Setup.exe 结尾的文件为安装版,具备「自动更新」功能,软件启动时会自动检测并安装更新。 但若你所在网络访问 GitHub 较慢,则可能会更新失败,这时需要手动下载安装包覆盖安装。 以 green.7z 结尾的文件为免安装版,解压后可直接运行里面的 lx-music-desktop.exe,但无法自动更新。 带 x64 的文件适用于 64 位操作系统,x86 适用于 32 位操作系统,arm64 适用于较新的 Arm 机器。 2移动版以 .apk 结尾的文件适用于 Android 系统。 建议优先下载 arm64-v8a 安装包,若无法安装再下载 universal 安装包。 另外还有 armeabi-v7a/x86_64 等安装包,若有需要可自行下载。 版本号包含 sl 的安装包为「墨·状态栏」特别版,详情看状态栏歌词。 universal 安装包的内部版本号总是低于单架构安装包的内部版本(包括跨版本)。安装新版本时,如果遇到版本号太低的提示,请尝试使用其他单架构安装包。 目前没有计划支持 iOS 和 HarmonyOS NEXT。 2安装洛雪音乐1) 下载安装包,双击 lx-music-desktop-v2.12.0.exe 启动安装:2) 点击 “我同意”:3) 点击 “下一步”:4) 系统默认安装到 C 盘,这里强烈建议手动修改到其他盘(非系统盘),点击 “安装”:5) 等待进度条加载到 100%:6) 点击 “完成”:7) 出现下图所示界面,安装完成:三、使用洛雪音乐1) 点击 “设置”:2) 点击 “自定义源管理”:3) 点击 “在线导入”:4) 复制 https://ghproxy.net/https://raw.githubusercontent.com/pdone/lx-music-source/main/flower/latest.js 或者 https://tt.tenmeng.com/moonue/js/yecao202412.js ,粘贴到方框内,点击 “导入”:5) 导入完成后,关闭窗口:6) 勾选导入的源,就可以使用了:四、洛雪音乐常见问题1) 无法播放/下载:切音源 → 清缓存 → 换网络 → 关防火墙 → 升最新版。2) 桌面歌词/列表缺失:洛雪定位 “查歌器”,非完整播放器,可外接 foobar 使用。3) 歌单同步失败:同一局域网 → 实验性同步 → 数据明文勿在公网用。4) 音源导入失败:路径无中文 → 文件权限→ 客户端 1.6.0+ →重启生效。 -

Debian13-安装最新版qbittorrent-Nox,干掉默认密码并重置密码 0 前言最近购买的大盘鸡装的系统是Debian13,用之前的一键脚本报错 新手PT刷流一键安装与使用教程 ,提示脚本不支持Debian13。1 安装与配置1.1新源可以在此查询构建好的包1) 备份并编辑源列表sudo cp /etc/apt/sources.list /etc/apt/sources.list.bak sudo nano /etc/apt/sources.list添加以下内容 这里添加了trixie 源deb http://deb.debian.org/debian trixie main contrib non-free deb-src http://deb.debian.org/debian trixie main contrib non-free2) 更新包索引sudo apt update1.2 安装qbittorrent-nox直接使用以下命令安装qbittorrent-nox:sudo apt install qbittorrent-nox -y1.3设置开机自启动1)创建qbittorrent-nox.service文件:nano /etc/systemd/system/qbittorrent-nox.service2)把以下内容复制进去:[Unit] Description=qBittorrent Command Line Client After=network.target [Service] Type=simple User=root Group=root UMask=007 WorkingDirectory=/root/.config/qBittorrent ExecStart=/usr/bin/qbittorrent-nox --webui-port=8080 Restart=on-failure [Install] WantedBy=multi-user.target3)按Ctrl+O保存,再按Ctrl+x退出。4)修改qbittorrent-nox.service文件后重新载入:sudo systemctl daemon-reload5)设置开机启动:sudo systemctl enable qbittorrent-nox6)启动qbittorrent-nox:sudo systemctl start qbittorrent-nox7)停止qbittorrent-nox:sudo systemctl stop qbittorrent-nox8)安装完成打开浏览器,输入http//ip地址:8080,就可以打开qbittorrent-nox的webui了1.4 密码问题1)关于默认密码新版本qbittorrent不再使用默认密码,而是随机生成密码,应该会输出在日志里。2)查看日志journalctl -fu qbittorrent-nox可以看到账号密码3)修改密码(1)手动修改配置文件如果没有正确输出,可以手动修改配置文件vim /etc/systemd/system/qbittorrent-nox.service(2)添加WorkingDirectory[Unit] Description=qBittorrent Command Line Client After=network.target [Service] Type=simple User=root Group=root UMask=007 WorkingDirectory=/root/.config/qBittorrent ExecStart=/usr/bin/qbittorrent-nox --webui-port=8080 Restart=on-failure [Install] WantedBy=multi-user.target(3)编辑配置文件vim /root/.config/qBittorrent/qBittorrent.conf(4)添加以下内容[Preferences] WebUI\Password_PBKDF2="@ByteArray(ARQ77eY1NUZaQsuDHbIMCA==:0WMRkYTUWVT9wVvdDtHAjU9b3b7uB8NR1Gur2hmQCvCDpm39Q+PsJRJPaCU51dEiz+dTzh8qbPsL8WkFljQYFQ==)"4)重载密码# 停止服务 systemctl stop qbittorrent-nox # 重新加载 systemd 配置 systemctl daemon-reload # 启动服务 systemctl start qbittorrent-nox此时能用账号密码admin adminadmin登录,记得登录后修改默认账号密码。

Debian13-安装最新版qbittorrent-Nox,干掉默认密码并重置密码 0 前言最近购买的大盘鸡装的系统是Debian13,用之前的一键脚本报错 新手PT刷流一键安装与使用教程 ,提示脚本不支持Debian13。1 安装与配置1.1新源可以在此查询构建好的包1) 备份并编辑源列表sudo cp /etc/apt/sources.list /etc/apt/sources.list.bak sudo nano /etc/apt/sources.list添加以下内容 这里添加了trixie 源deb http://deb.debian.org/debian trixie main contrib non-free deb-src http://deb.debian.org/debian trixie main contrib non-free2) 更新包索引sudo apt update1.2 安装qbittorrent-nox直接使用以下命令安装qbittorrent-nox:sudo apt install qbittorrent-nox -y1.3设置开机自启动1)创建qbittorrent-nox.service文件:nano /etc/systemd/system/qbittorrent-nox.service2)把以下内容复制进去:[Unit] Description=qBittorrent Command Line Client After=network.target [Service] Type=simple User=root Group=root UMask=007 WorkingDirectory=/root/.config/qBittorrent ExecStart=/usr/bin/qbittorrent-nox --webui-port=8080 Restart=on-failure [Install] WantedBy=multi-user.target3)按Ctrl+O保存,再按Ctrl+x退出。4)修改qbittorrent-nox.service文件后重新载入:sudo systemctl daemon-reload5)设置开机启动:sudo systemctl enable qbittorrent-nox6)启动qbittorrent-nox:sudo systemctl start qbittorrent-nox7)停止qbittorrent-nox:sudo systemctl stop qbittorrent-nox8)安装完成打开浏览器,输入http//ip地址:8080,就可以打开qbittorrent-nox的webui了1.4 密码问题1)关于默认密码新版本qbittorrent不再使用默认密码,而是随机生成密码,应该会输出在日志里。2)查看日志journalctl -fu qbittorrent-nox可以看到账号密码3)修改密码(1)手动修改配置文件如果没有正确输出,可以手动修改配置文件vim /etc/systemd/system/qbittorrent-nox.service(2)添加WorkingDirectory[Unit] Description=qBittorrent Command Line Client After=network.target [Service] Type=simple User=root Group=root UMask=007 WorkingDirectory=/root/.config/qBittorrent ExecStart=/usr/bin/qbittorrent-nox --webui-port=8080 Restart=on-failure [Install] WantedBy=multi-user.target(3)编辑配置文件vim /root/.config/qBittorrent/qBittorrent.conf(4)添加以下内容[Preferences] WebUI\Password_PBKDF2="@ByteArray(ARQ77eY1NUZaQsuDHbIMCA==:0WMRkYTUWVT9wVvdDtHAjU9b3b7uB8NR1Gur2hmQCvCDpm39Q+PsJRJPaCU51dEiz+dTzh8qbPsL8WkFljQYFQ==)"4)重载密码# 停止服务 systemctl stop qbittorrent-nox # 重新加载 systemd 配置 systemctl daemon-reload # 启动服务 systemctl start qbittorrent-nox此时能用账号密码admin adminadmin登录,记得登录后修改默认账号密码。 -

【Telegram 受限媒体下载器】一个功能强大的油猴脚本,用于下载 Telegram Web 中的配置图片和视频,支持最佳质量下载 1 项目地址脚本地址:https://greasyfork.org/zh-CN/scripts/560901-telegram-受限媒体下载器项目地址:https://github.com/weiruankeji2025/weiruan-Telegram2 项目简介🚀 Telegram 受限媒体下载器一个功能强大的油猴脚本,用于下载 Telegram Web 中的受限图片和视频,支持最佳质量下载。✨ 主要功能📥 全面下载支持✅ 下载所有受限图片(包括 Canvas 渲染的图片)✅ 下载所有受限视频✅ 自动获取最佳质量的媒体文件✅ 支持多种媒体格式🎨 用户友好界面✅ 精美的悬浮下载按钮(渐变色设计)✅ 可自定义按钮位置(四个角落可选)✅ 实时下载进度提示✅ Toast 通知 + 系统通知双重提醒✅ 平滑的动画效果⚙️ 丰富的设置选项✅ 自定义下载文件夹名称✅ 三档质量选择(最佳/中等/低)✅ 按钮位置自定义✅ 通知开关控制✅ 所有设置持久化保存🔓 绕过限制✅ 自动绕过右键菜单限制✅ 解除复制粘贴限制✅ 移除拖拽限制✅ 解除选择文本限制🎯 智能识别✅ 自动扫描页面媒体元素✅ 实时监听 DOM 变化✅ 智能过滤小图标✅ 支持动态加载的内容3📦 安装步骤步骤 1: 安装油猴扩展根据你的浏览器选择对应的油猴扩展:Chrome: Tampermonkey Firefox: TampermonkeyEdge: TampermonkeySafari: TampermonkeyOpera: Tampermonkey步骤 2: 安装脚本点击这里安装脚本: telegram-media-downloader.user.js或者手动安装:打开 Tampermonkey 管理面板点击 "+" 创建新脚本复制 telegram-media-downloader.user.js 的内容粘贴并保存步骤 3: 刷新 Telegram打开 Telegram Web刷新页面(F5 或 Ctrl+R)看到 "下载器已就绪" 通知即表示成功!4🎮 使用方法基础使用打开 Telegram Web 并登录浏览任何频道或聊天查看图片或视频时,会自动显示下载按钮点击下载按钮即可保存媒体文件下载按钮说明下载按钮会显示在媒体元素上,有以下三种状态:状态 图标颜色 说明🟣 紫色渐变 正常状态 可以点击下载🔴 红色渐变 下载中 正在下载,请稍候🔵 蓝色渐变 下载完成 下载成功(2秒后恢复)打开设置面板有两种方式打开设置:点击油猴图标 → 选择 "⚙️ 打开设置"在页面任意位置 → 右键 → Tampermonkey → "⚙️ 打开设置"设置选项详解📁 下载文件夹名称设置下载文件的保存文件夹默认: Telegram示例: TelegramMedia, Downloads/Telegram🎨 下载质量最佳质量: 下载原始高清媒体(推荐)中等质量: 下载中等分辨率媒体低质量: 下载低分辨率媒体(节省空间)📍 按钮位置右上角: 默认位置右下角: 适合大屏幕左上角: 适合左撇子左下角: 个性化选择🔔 启用下载通知开启后会显示下载进度和结果通知包括页面内 Toast 和系统通知5🎯 功能展示界面效果┌─────────────────────────────────────┐│ Telegram Chat ││ ┌───────────────┐ [下载图片] ←──┐││ │ │ │││ │ 媒体内容 │ 悬浮下载按钮 │││ │ │ │││ └───────────────┘ │││ ││ Toast 通知: "下载完成!" │└─────────────────────────────────────┘通知示例✅ "下载器已就绪 - Telegram 媒体下载器已成功加载!"📥 "开始下载 - 正在下载图片..."✔️ "下载完成 - 图片已保存到: Telegram/telegram_image_1234567890.jpg"❌ "下载失败 - 请重试"🔧 高级功能手动重新扫描如果某些媒体没有显示下载按钮:点击油猴图标选择 "🔄 重新扫描媒体"等待几秒钟支持的媒体类型类型 格式 说明图片 JPG, PNG, WebP 自动选择最佳质量视频 MP4, WebM 支持高清视频Canvas PNG 受限内容转换文件命名规则下载的文件会自动命名为:{文件夹}/{媒体类型}_{时间戳}.{扩展名}示例:Telegram/telegram_image_1704067200000.jpgTelegram/telegram_video_1704067200000.mp4🛠️ 技术特性✅ 零依赖: 纯 JavaScript 实现✅ 轻量级: 代码简洁高效✅ 高性能: 使用 MutationObserver 实时监听✅ 安全性: 不收集任何用户数据✅ 兼容性: 支持所有主流浏览器✅ 响应式: 自适应各种屏幕尺寸6📋 常见问题Q1: 为什么有些媒体没有下载按钮?A: 可能的原因:媒体还在加载中,请等待几秒图片太小(小于 100x100),被过滤了使用 "🔄 重新扫描媒体" 功能Q2: 下载的文件保存在哪里?A:浏览器会弹出保存对话框你可以选择具体的保存位置默认会使用你设置的文件夹名称Q3: 可以批量下载吗?A:当前版本需要逐个点击下载未来版本会考虑添加批量下载功能Q4: 下载速度慢怎么办?A:这取决于你的网络速度和 Telegram 服务器可以尝试切换到 "中等质量" 或 "低质量"Q5: 脚本安全吗?A:✅ 完全开源,代码可审计✅ 不收集任何个人信息✅ 所有设置保存在本地✅ 使用 Tampermonkey 的安全 APIQ6: 支持移动端吗?A:需要移动浏览器支持油猴扩展推荐使用 Kiwi Browser (Android) + TampermonkeyiOS 可以使用 Safari + Userscripts

【Telegram 受限媒体下载器】一个功能强大的油猴脚本,用于下载 Telegram Web 中的配置图片和视频,支持最佳质量下载 1 项目地址脚本地址:https://greasyfork.org/zh-CN/scripts/560901-telegram-受限媒体下载器项目地址:https://github.com/weiruankeji2025/weiruan-Telegram2 项目简介🚀 Telegram 受限媒体下载器一个功能强大的油猴脚本,用于下载 Telegram Web 中的受限图片和视频,支持最佳质量下载。✨ 主要功能📥 全面下载支持✅ 下载所有受限图片(包括 Canvas 渲染的图片)✅ 下载所有受限视频✅ 自动获取最佳质量的媒体文件✅ 支持多种媒体格式🎨 用户友好界面✅ 精美的悬浮下载按钮(渐变色设计)✅ 可自定义按钮位置(四个角落可选)✅ 实时下载进度提示✅ Toast 通知 + 系统通知双重提醒✅ 平滑的动画效果⚙️ 丰富的设置选项✅ 自定义下载文件夹名称✅ 三档质量选择(最佳/中等/低)✅ 按钮位置自定义✅ 通知开关控制✅ 所有设置持久化保存🔓 绕过限制✅ 自动绕过右键菜单限制✅ 解除复制粘贴限制✅ 移除拖拽限制✅ 解除选择文本限制🎯 智能识别✅ 自动扫描页面媒体元素✅ 实时监听 DOM 变化✅ 智能过滤小图标✅ 支持动态加载的内容3📦 安装步骤步骤 1: 安装油猴扩展根据你的浏览器选择对应的油猴扩展:Chrome: Tampermonkey Firefox: TampermonkeyEdge: TampermonkeySafari: TampermonkeyOpera: Tampermonkey步骤 2: 安装脚本点击这里安装脚本: telegram-media-downloader.user.js或者手动安装:打开 Tampermonkey 管理面板点击 "+" 创建新脚本复制 telegram-media-downloader.user.js 的内容粘贴并保存步骤 3: 刷新 Telegram打开 Telegram Web刷新页面(F5 或 Ctrl+R)看到 "下载器已就绪" 通知即表示成功!4🎮 使用方法基础使用打开 Telegram Web 并登录浏览任何频道或聊天查看图片或视频时,会自动显示下载按钮点击下载按钮即可保存媒体文件下载按钮说明下载按钮会显示在媒体元素上,有以下三种状态:状态 图标颜色 说明🟣 紫色渐变 正常状态 可以点击下载🔴 红色渐变 下载中 正在下载,请稍候🔵 蓝色渐变 下载完成 下载成功(2秒后恢复)打开设置面板有两种方式打开设置:点击油猴图标 → 选择 "⚙️ 打开设置"在页面任意位置 → 右键 → Tampermonkey → "⚙️ 打开设置"设置选项详解📁 下载文件夹名称设置下载文件的保存文件夹默认: Telegram示例: TelegramMedia, Downloads/Telegram🎨 下载质量最佳质量: 下载原始高清媒体(推荐)中等质量: 下载中等分辨率媒体低质量: 下载低分辨率媒体(节省空间)📍 按钮位置右上角: 默认位置右下角: 适合大屏幕左上角: 适合左撇子左下角: 个性化选择🔔 启用下载通知开启后会显示下载进度和结果通知包括页面内 Toast 和系统通知5🎯 功能展示界面效果┌─────────────────────────────────────┐│ Telegram Chat ││ ┌───────────────┐ [下载图片] ←──┐││ │ │ │││ │ 媒体内容 │ 悬浮下载按钮 │││ │ │ │││ └───────────────┘ │││ ││ Toast 通知: "下载完成!" │└─────────────────────────────────────┘通知示例✅ "下载器已就绪 - Telegram 媒体下载器已成功加载!"📥 "开始下载 - 正在下载图片..."✔️ "下载完成 - 图片已保存到: Telegram/telegram_image_1234567890.jpg"❌ "下载失败 - 请重试"🔧 高级功能手动重新扫描如果某些媒体没有显示下载按钮:点击油猴图标选择 "🔄 重新扫描媒体"等待几秒钟支持的媒体类型类型 格式 说明图片 JPG, PNG, WebP 自动选择最佳质量视频 MP4, WebM 支持高清视频Canvas PNG 受限内容转换文件命名规则下载的文件会自动命名为:{文件夹}/{媒体类型}_{时间戳}.{扩展名}示例:Telegram/telegram_image_1704067200000.jpgTelegram/telegram_video_1704067200000.mp4🛠️ 技术特性✅ 零依赖: 纯 JavaScript 实现✅ 轻量级: 代码简洁高效✅ 高性能: 使用 MutationObserver 实时监听✅ 安全性: 不收集任何用户数据✅ 兼容性: 支持所有主流浏览器✅ 响应式: 自适应各种屏幕尺寸6📋 常见问题Q1: 为什么有些媒体没有下载按钮?A: 可能的原因:媒体还在加载中,请等待几秒图片太小(小于 100x100),被过滤了使用 "🔄 重新扫描媒体" 功能Q2: 下载的文件保存在哪里?A:浏览器会弹出保存对话框你可以选择具体的保存位置默认会使用你设置的文件夹名称Q3: 可以批量下载吗?A:当前版本需要逐个点击下载未来版本会考虑添加批量下载功能Q4: 下载速度慢怎么办?A:这取决于你的网络速度和 Telegram 服务器可以尝试切换到 "中等质量" 或 "低质量"Q5: 脚本安全吗?A:✅ 完全开源,代码可审计✅ 不收集任何个人信息✅ 所有设置保存在本地✅ 使用 Tampermonkey 的安全 APIQ6: 支持移动端吗?A:需要移动浏览器支持油猴扩展推荐使用 Kiwi Browser (Android) + TampermonkeyiOS 可以使用 Safari + Userscripts -

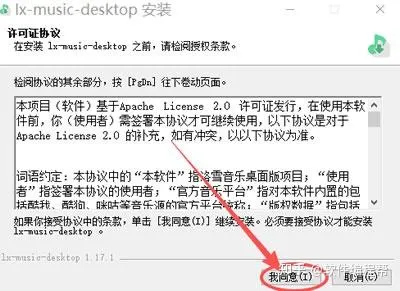

分享个适合长期使用win10精简系统,附上dd教程 原帖来自nodeseek1 概述闲来无事想让家里电视机也能运行电脑系统于是想起手上有个爪云延迟也不错,ddwin10借助安卓远程协助软件连接免翻墙看油管 搭配爪云真不错所用到的小鸡:爪云日本2c4g所用到的系统:win10-22h2不忘初心精简版2 特性系统大小仅有1g左右安装完毕系统占用4.51g占用内存情况油管最高可以看1080p画面挺流畅,cpu占用大约百分之60,使用的是火狐浏览器3 DD教程win10-22h2不忘初心精简版:https://www.now61.com/s/DYxjCk1首先打开链接点击下载2获取下载链接并保存待一会复制3开始dd,在小鸡上面输入以下命令,下载所需dd文件(所用到的dd来源https://github.com/bin456789/reinstall )国外服务器:curl -O https://raw.githubusercontent.com/bin456789/reinstall/main/reinstall.sh || wget -O ${_##*/} $_国内服务器:curl -O https://cnb.cool/bin456789/reinstall/-/git/raw/main/reinstall.sh || wget -O ${_##*/} $_4输入以下命令开始dd,这里会用到第二步保存好的链接,替换掉下载链接bash reinstall.sh dd --img "下载链接"5一直按回车,等看见下方文字大功告成,输入:reboot重启即可6如果你的小鸡带有VNC,可以打开查看实时进度,如果没有就静静等待一般半小时内系统应该可以安装成功。7系统不带任何浏览器 xhj016 需要手动下载,开始-运行-cmd-命令行 输入以下命令手动下载,默认文件保存桌面Invoke-WebRequest -Uri "文件的下载链接" -OutFile "$env:USERPROFILE\Desktop\文件名.扩展名"8远程桌面默认连接信息(密码记得修改)端口:3389 用户名: Administrator 密码: tg@wanglong64 工具集在附上几个系统实用小工具1 定时清理系统运行内存,适合低内存小鸡使用https://github.com/henrypp/memreduct2 dd必备,快速修改远程连接端口,不推荐长期使用3389。我习惯修改成22https://www.now61.com/s/3qZPTj2 激活工具,懂得都懂 yct008https://www.now61.com/s/eJbnSe

分享个适合长期使用win10精简系统,附上dd教程 原帖来自nodeseek1 概述闲来无事想让家里电视机也能运行电脑系统于是想起手上有个爪云延迟也不错,ddwin10借助安卓远程协助软件连接免翻墙看油管 搭配爪云真不错所用到的小鸡:爪云日本2c4g所用到的系统:win10-22h2不忘初心精简版2 特性系统大小仅有1g左右安装完毕系统占用4.51g占用内存情况油管最高可以看1080p画面挺流畅,cpu占用大约百分之60,使用的是火狐浏览器3 DD教程win10-22h2不忘初心精简版:https://www.now61.com/s/DYxjCk1首先打开链接点击下载2获取下载链接并保存待一会复制3开始dd,在小鸡上面输入以下命令,下载所需dd文件(所用到的dd来源https://github.com/bin456789/reinstall )国外服务器:curl -O https://raw.githubusercontent.com/bin456789/reinstall/main/reinstall.sh || wget -O ${_##*/} $_国内服务器:curl -O https://cnb.cool/bin456789/reinstall/-/git/raw/main/reinstall.sh || wget -O ${_##*/} $_4输入以下命令开始dd,这里会用到第二步保存好的链接,替换掉下载链接bash reinstall.sh dd --img "下载链接"5一直按回车,等看见下方文字大功告成,输入:reboot重启即可6如果你的小鸡带有VNC,可以打开查看实时进度,如果没有就静静等待一般半小时内系统应该可以安装成功。7系统不带任何浏览器 xhj016 需要手动下载,开始-运行-cmd-命令行 输入以下命令手动下载,默认文件保存桌面Invoke-WebRequest -Uri "文件的下载链接" -OutFile "$env:USERPROFILE\Desktop\文件名.扩展名"8远程桌面默认连接信息(密码记得修改)端口:3389 用户名: Administrator 密码: tg@wanglong64 工具集在附上几个系统实用小工具1 定时清理系统运行内存,适合低内存小鸡使用https://github.com/henrypp/memreduct2 dd必备,快速修改远程连接端口,不推荐长期使用3389。我习惯修改成22https://www.now61.com/s/3qZPTj2 激活工具,懂得都懂 yct008https://www.now61.com/s/eJbnSe -

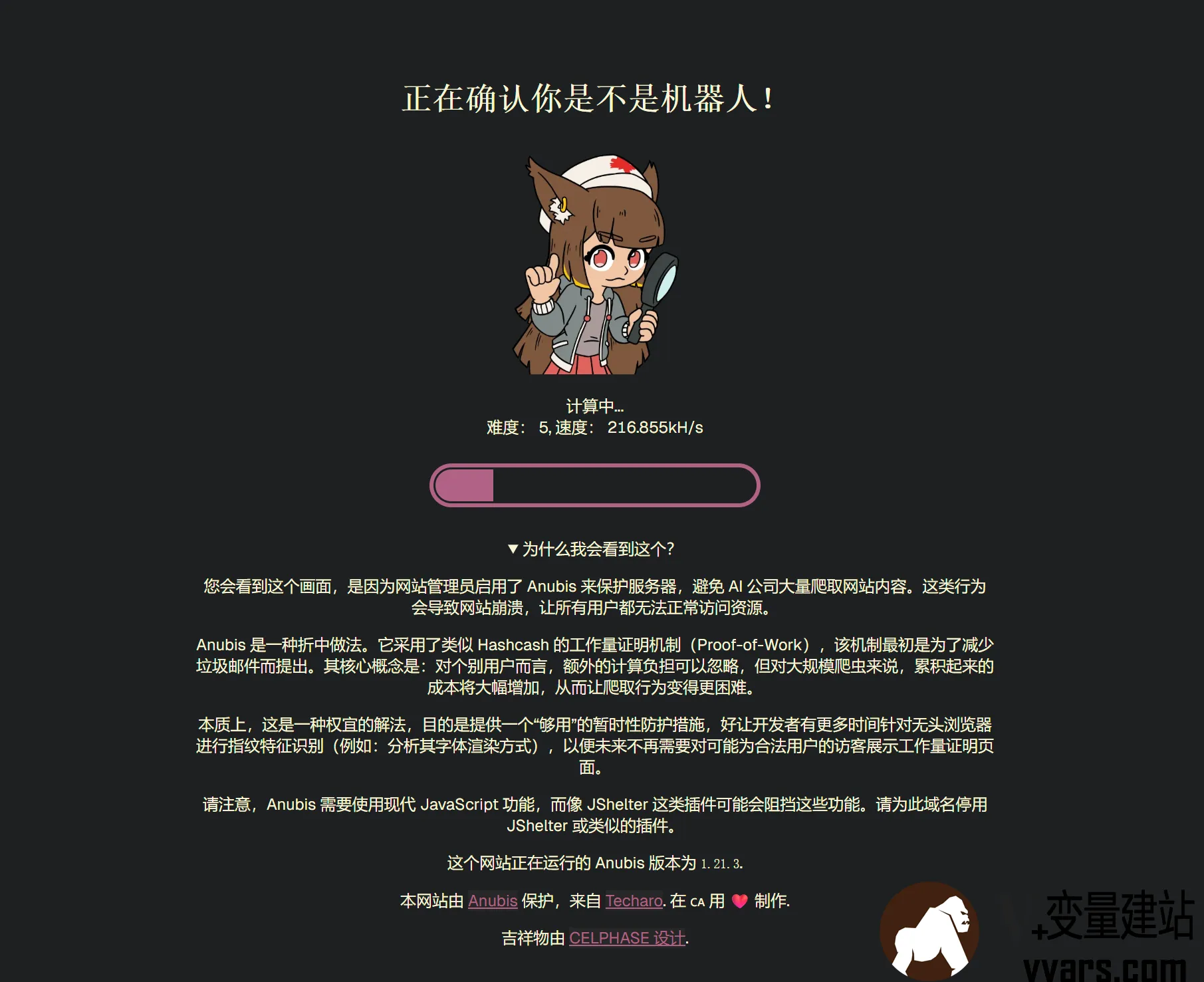

在用户的浏览器里挖矿——Anubis 网站防护工具配置教程 一、项目背景Anubis工作模式类似于Cloudflare的Javascript挑战,拦截请求之后,用户需要通过挑战之后才能继续访问。而Anubis需要客户端完成一定难度的Hash计算,简单说就是挖矿。客户端需要进行一定负载的计算,计算出正确结果之后才能进入网站。这对于正常用户的客户端来说并不算是什么,在难度2-4下,大概率计算时间小于2秒钟,一闪而过用户感知小。在难度5-6时,浏览器需要进行10-30秒以上的计算。在CC攻击的时候,攻击者会控制大量的无头浏览器进行攻击,使用Anubis之后,会在攻击者的无头浏览器中执行Hash计算,高难度的Hash计算会拖垮攻击者的服务器,从而降低攻击频率。项目官网我在本地Debian12 + NGINX系统中已经跑通,随后我会发表一篇博客详细描述配置PS;Anubis有非常强大的功能,包括针对不用GEOIP、不同AS的规则,正在进一步探索中。PPS;试了下难度设置为6,大概1分钟才计算完成,期间CPU(i5-13490H)占用80%左右。二、工作原理1 AnubisAnubis是一个网站防护工具,其工作原理类似常见的Cloudflare验证,会在用户进入网站之前对客户端进行检查。客户端需要完成一定难度的Hash计算,服务器验证计算结果后放行,Hash计算代表了客户端可能需要执行几千几万次的计算,而服务器验证执行执行一次,对服务器开销小。当有网络爬虫、CC攻击想进入源站是,需要在攻击者的客户端(比如无头浏览器中)进行一定量的Hash计算,攻击者一般会在一台物理机中运行多个配置了代理的无头浏览器,这些Hash计算会拖垮攻击者的服务器,从而迫使攻击者放弃或减低攻击频率。现代设备通常都具有一定的限制算力,这些任务对于这些客户端来说,通常只需要几毫秒或几秒中即可完成,用户只需要等待一段时间,不需要进行任何操作,成功后会自动进入实际后端服务。2.工作原理Hash计算和经典的比特币挖矿一致,客户端需要使用一个确定的字符串加上任意数字,进行 sha256 计算,得到的 64 为hash值的前x个数为 0,x就是difficultyconst hash = await sha256(`${challenge}${nonce}`);整体流程客户端第一次访问时,会根据访问者的IP、ASN、User-Agent,服务器的工作负载,计算出一个数值 weight,之后通过 weight 匹配不同难度的Hash计算任务给客户端。客户端完成计算后,由服务器进行验证,成功之后放行到真正的后端服务,同时返回 Set-Cookies 以保存一段时间验证结果,当用户下次访问时,可复用上次的验证结果。3.与NGINX搭配![[Pasted image 20250821210211.png]]流量从 80/443 端口进入之后,先交给Anubis进行拦截,延迟完成之后在交还回NGINX进行后续流程。在单个服务器内通过unix socks进行交互。三、安装/配置教程此处以Debian 12 系统为例1 安装Anubis1)下载并安装(1)请在Github获取最新的版本号wget -O /tmp/anubis.deb https://github.com/TecharoHQ/anubis/releases/download/v1.21.3/anubis_1.21.3_amd64.deb && apt install /tmp/anubis.deb(2)不能直连Github,可以使用加速域名,或者手动下载上传到服务器wget -O /tmp/anubis.deb https://ghfast.top/https://github.com/TecharoHQ/anubis/releases/download/v1.21.3/anubis_1.21.3_amd64.deb && apt install /tmp/anubis.deb(3)修改 /etc/anubis/default.env,内容如下BIND=/run/anubis/instance.sock BIND_NETWORK=unix SOCKET_MODE=0666 TARGET=unix:///run/nginx/nginx.sock(4)复制默认策略文件,暂不修改cp /usr/share/doc/anubis/botPolicies.yaml /etc/anubis/botPolicies.yaml2)systemd运行(1)创建service文件vi /etc/systemd/system/anubis.service[Unit] Description=Anubis Bot Protection After=network.target [Service] EnvironmentFile=/etc/anubis/default.env ExecStart=/usr/bin/anubis \ -bind /run/anubis/instance.sock \ -bind-network unix \ -socket-mode 0666 \ -target unix:///run/nginx/nginx.sock \ -metrics-bind 127.0.0.1:9091 \ -metrics-bind-network tcp \ -policy-fname /etc/anubis/botPolicies.yaml Restart=always User=www-data Group=www-data [Install] WantedBy=multi-user.target(2)创建目录mkdir -p /run/anubis /run/nginx(3)修改权限此处的用户和NGINX相同chown www-data:www-data /run/anubis /run/nginx(4)启用Anubissystemctl enable --now anubis.service(5)确保已经成功运行systemctl status anubis2 配置NGINX此处提供一份可用NGINX,请自行修改扩展user root; worker_processes auto; pid /run/nginx.pid; events { worker_connections 1024; } http { upstream anubis { server unix:/run/anubis/instance.sock; } server { listen 443 ssl http2; server_name uptime.vio.vin; ssl_certificate /etc/ssl/violet/certs/all.vio.vin.cert.pem; ssl_certificate_key /etc/ssl/violet/certs/all.vio.vin.key.pem; location / { proxy_set_header Host $host; proxy_set_header X-Real-IP $remote_addr; proxy_pass http://anubis; } } server { listen unix:/run/nginx/nginx.sock; server_name uptime.vio.vin; location / { proxy_pass http://10.115.15.178:3001; proxy_set_header Host $host; proxy_set_header X-Real-IP $remote_addr; } } }upstream:定义上游服务器为anubis第一个server:监听 443 入站连接,传输给anubis,传输客户端IP用于IP相关策略判断第二个server:anubis验证通过之后,实际反向代理的位置至此,基础配置已完成,默认情况下低分析客户端难度为 2,高风险为 43 Bot策略官网文档:https://anubis.techaro.lol/docs/admin/policies需要调整 botPolicies.yaml 文件默认的botPolicies.yaml 配置文件:https://github.com/TecharoHQ/anubis/blob/main/data/botPolicies.yamlbots中定义了多个规则,可以看到已经通过import导入了一部分规则,这部分的文件可以在 /usr/share/doc/anubis/data/bots 中找到默认的规则如下,可以仿照这些规则写自己的规则1)可配置匹配规则(1)匹配请求头/usr/share/doc/anubis/data/bots/cloudflare-workers.yaml- name: cloudflare-workers headers_regex: CF-Worker: .* action: WEIGH weight: adjust: 15(2)匹配User-Agent/usr/share/doc/anubis/data/bots/headless-browsers.yaml- name: lightpanda user_agent_regex: ^LightPanda/.*$ action: DENY - name: headless-chrome user_agent_regex: HeadlessChrome action: DENY - name: headless-chromium user_agent_regex: HeadlessChromium action: DENY(3)指定表达式/usr/share/doc/anubis/data/bots/aggressive-brazilian-scrapers.yaml- name: deny-aggressive-brazilian-scrapers action: WEIGH weight: adjust: 20 expression: any: # Internet Explorer should be out of support - userAgent.contains("MSIE") # Trident is the Internet Explorer browser engine - userAgent.contains("Trident") # Opera is a fork of chrome now - userAgent.contains("Presto") # Windows CE is discontinued - userAgent.contains("Windows CE") # Windows 95 is discontinued - userAgent.contains("Windows 95") # Windows 98 is discontinued - userAgent.contains("Windows 98") # Windows 9.x is discontinued - userAgent.contains("Win 9x") # Amazon does not have an Alexa Toolbar. - userAgent.contains("Alexa Toolbar") # This is not released, even Windows 11 calls itself Windows 10 - userAgent.contains("Windows NT 11.0") # iPods are not in common use - userAgent.contains("iPod")(4)匹配客户端IP/usr/share/doc/anubis/data/clients/mistral-mistralai-user.yaml# Acts on behalf of user requests # https://docs.mistral.ai/robots/ - name: mistral-mistralai-user user_agent_regex: MistralAI-User/.+; \+https\://docs\.mistral\.ai/robots action: ALLOW # https://mistral.ai/mistralai-user-ips.json remote_addresses: [ "20.240.160.161/32", "20.240.160.1/32", ](5)匹配GEOIP- name: countries-with-aggressive-scrapers action: WEIGH geoip: countries: - BR - CN weight: adjust: 10(6)匹配ASN- name: aggressive-asns-without-functional-abuse-contact action: WEIGH asns: match: - 13335 # Cloudflare - 136907 # Huawei Cloud - 45102 # Alibaba Cloud weight: adjust: 10(7)匹配后动作动作 解释ALLOW 允许,跳过后续所有检查DENY 拒绝访问CHALLENGE 进行客户端挑战WEIGH 修改请求权重ALLOW和DENY不再解释2)CHALLENGE- name: generic-bot-catchall user_agent_regex: (?i:bot|crawler) action: CHALLENGE challenge: difficulty: 16 # impossible report_as: 4 # lie to the operator algorithm: slow # intentionally waste CPU cycles and timename:名称,可自定义user_agent_regex:正则表达式匹配User-Agentaction:动作,立即进行客户端挑战challenge:客户端挑战配置difficulty:难度,16 表示计算出的hash值前 16 位为 0,不可能完成(比特币的前导 0 个数为 19-20),在客户端完成 16 为的计算可能需要几万年甚至更久(攻击者看者 99%的CPU陷入沉思)report_as:用户在界面上看到的难度数值(你甚至可以骗他,这个进度条怎么一直卡在 99%不走呢)algorithm:采用的Hash算法,slow故意折磨CPU3)WEIGH调整请求的权重,正数为增加权重,负数为减少权重,后续会进入到 thresholds 中,针对不同的请求设置不同的CHALLENGE0-10 的权重,进行快速算法,几乎不需要等待- name: mild-suspicion expression: all: - weight > 0 - weight < 10 action: CHALLENGE challenge: algorithm: metarefresh difficulty: 2 report_as: 24)其他根据服务器负载动态调整示例在配置文件中已给出,有需要可以启用 # ## System load based checks. # # If the system is under high load, add weight. # - name: high-load-average # action: WEIGH # expression: load_1m >= 10.0 # make sure to end the load comparison in a .0 # weight: # adjust: 20 ## If your backend service is running on the same operating system as Anubis, ## you can uncomment this rule to make the challenge easier when the system is ## under low load. ## ## If it is not, remove weight. # - name: low-load-average # action: WEIGH # expression: load_15m <= 4.0 # make sure to end the load comparison in a .0 # weight: # adjust: -10

在用户的浏览器里挖矿——Anubis 网站防护工具配置教程 一、项目背景Anubis工作模式类似于Cloudflare的Javascript挑战,拦截请求之后,用户需要通过挑战之后才能继续访问。而Anubis需要客户端完成一定难度的Hash计算,简单说就是挖矿。客户端需要进行一定负载的计算,计算出正确结果之后才能进入网站。这对于正常用户的客户端来说并不算是什么,在难度2-4下,大概率计算时间小于2秒钟,一闪而过用户感知小。在难度5-6时,浏览器需要进行10-30秒以上的计算。在CC攻击的时候,攻击者会控制大量的无头浏览器进行攻击,使用Anubis之后,会在攻击者的无头浏览器中执行Hash计算,高难度的Hash计算会拖垮攻击者的服务器,从而降低攻击频率。项目官网我在本地Debian12 + NGINX系统中已经跑通,随后我会发表一篇博客详细描述配置PS;Anubis有非常强大的功能,包括针对不用GEOIP、不同AS的规则,正在进一步探索中。PPS;试了下难度设置为6,大概1分钟才计算完成,期间CPU(i5-13490H)占用80%左右。二、工作原理1 AnubisAnubis是一个网站防护工具,其工作原理类似常见的Cloudflare验证,会在用户进入网站之前对客户端进行检查。客户端需要完成一定难度的Hash计算,服务器验证计算结果后放行,Hash计算代表了客户端可能需要执行几千几万次的计算,而服务器验证执行执行一次,对服务器开销小。当有网络爬虫、CC攻击想进入源站是,需要在攻击者的客户端(比如无头浏览器中)进行一定量的Hash计算,攻击者一般会在一台物理机中运行多个配置了代理的无头浏览器,这些Hash计算会拖垮攻击者的服务器,从而迫使攻击者放弃或减低攻击频率。现代设备通常都具有一定的限制算力,这些任务对于这些客户端来说,通常只需要几毫秒或几秒中即可完成,用户只需要等待一段时间,不需要进行任何操作,成功后会自动进入实际后端服务。2.工作原理Hash计算和经典的比特币挖矿一致,客户端需要使用一个确定的字符串加上任意数字,进行 sha256 计算,得到的 64 为hash值的前x个数为 0,x就是difficultyconst hash = await sha256(`${challenge}${nonce}`);整体流程客户端第一次访问时,会根据访问者的IP、ASN、User-Agent,服务器的工作负载,计算出一个数值 weight,之后通过 weight 匹配不同难度的Hash计算任务给客户端。客户端完成计算后,由服务器进行验证,成功之后放行到真正的后端服务,同时返回 Set-Cookies 以保存一段时间验证结果,当用户下次访问时,可复用上次的验证结果。3.与NGINX搭配![[Pasted image 20250821210211.png]]流量从 80/443 端口进入之后,先交给Anubis进行拦截,延迟完成之后在交还回NGINX进行后续流程。在单个服务器内通过unix socks进行交互。三、安装/配置教程此处以Debian 12 系统为例1 安装Anubis1)下载并安装(1)请在Github获取最新的版本号wget -O /tmp/anubis.deb https://github.com/TecharoHQ/anubis/releases/download/v1.21.3/anubis_1.21.3_amd64.deb && apt install /tmp/anubis.deb(2)不能直连Github,可以使用加速域名,或者手动下载上传到服务器wget -O /tmp/anubis.deb https://ghfast.top/https://github.com/TecharoHQ/anubis/releases/download/v1.21.3/anubis_1.21.3_amd64.deb && apt install /tmp/anubis.deb(3)修改 /etc/anubis/default.env,内容如下BIND=/run/anubis/instance.sock BIND_NETWORK=unix SOCKET_MODE=0666 TARGET=unix:///run/nginx/nginx.sock(4)复制默认策略文件,暂不修改cp /usr/share/doc/anubis/botPolicies.yaml /etc/anubis/botPolicies.yaml2)systemd运行(1)创建service文件vi /etc/systemd/system/anubis.service[Unit] Description=Anubis Bot Protection After=network.target [Service] EnvironmentFile=/etc/anubis/default.env ExecStart=/usr/bin/anubis \ -bind /run/anubis/instance.sock \ -bind-network unix \ -socket-mode 0666 \ -target unix:///run/nginx/nginx.sock \ -metrics-bind 127.0.0.1:9091 \ -metrics-bind-network tcp \ -policy-fname /etc/anubis/botPolicies.yaml Restart=always User=www-data Group=www-data [Install] WantedBy=multi-user.target(2)创建目录mkdir -p /run/anubis /run/nginx(3)修改权限此处的用户和NGINX相同chown www-data:www-data /run/anubis /run/nginx(4)启用Anubissystemctl enable --now anubis.service(5)确保已经成功运行systemctl status anubis2 配置NGINX此处提供一份可用NGINX,请自行修改扩展user root; worker_processes auto; pid /run/nginx.pid; events { worker_connections 1024; } http { upstream anubis { server unix:/run/anubis/instance.sock; } server { listen 443 ssl http2; server_name uptime.vio.vin; ssl_certificate /etc/ssl/violet/certs/all.vio.vin.cert.pem; ssl_certificate_key /etc/ssl/violet/certs/all.vio.vin.key.pem; location / { proxy_set_header Host $host; proxy_set_header X-Real-IP $remote_addr; proxy_pass http://anubis; } } server { listen unix:/run/nginx/nginx.sock; server_name uptime.vio.vin; location / { proxy_pass http://10.115.15.178:3001; proxy_set_header Host $host; proxy_set_header X-Real-IP $remote_addr; } } }upstream:定义上游服务器为anubis第一个server:监听 443 入站连接,传输给anubis,传输客户端IP用于IP相关策略判断第二个server:anubis验证通过之后,实际反向代理的位置至此,基础配置已完成,默认情况下低分析客户端难度为 2,高风险为 43 Bot策略官网文档:https://anubis.techaro.lol/docs/admin/policies需要调整 botPolicies.yaml 文件默认的botPolicies.yaml 配置文件:https://github.com/TecharoHQ/anubis/blob/main/data/botPolicies.yamlbots中定义了多个规则,可以看到已经通过import导入了一部分规则,这部分的文件可以在 /usr/share/doc/anubis/data/bots 中找到默认的规则如下,可以仿照这些规则写自己的规则1)可配置匹配规则(1)匹配请求头/usr/share/doc/anubis/data/bots/cloudflare-workers.yaml- name: cloudflare-workers headers_regex: CF-Worker: .* action: WEIGH weight: adjust: 15(2)匹配User-Agent/usr/share/doc/anubis/data/bots/headless-browsers.yaml- name: lightpanda user_agent_regex: ^LightPanda/.*$ action: DENY - name: headless-chrome user_agent_regex: HeadlessChrome action: DENY - name: headless-chromium user_agent_regex: HeadlessChromium action: DENY(3)指定表达式/usr/share/doc/anubis/data/bots/aggressive-brazilian-scrapers.yaml- name: deny-aggressive-brazilian-scrapers action: WEIGH weight: adjust: 20 expression: any: # Internet Explorer should be out of support - userAgent.contains("MSIE") # Trident is the Internet Explorer browser engine - userAgent.contains("Trident") # Opera is a fork of chrome now - userAgent.contains("Presto") # Windows CE is discontinued - userAgent.contains("Windows CE") # Windows 95 is discontinued - userAgent.contains("Windows 95") # Windows 98 is discontinued - userAgent.contains("Windows 98") # Windows 9.x is discontinued - userAgent.contains("Win 9x") # Amazon does not have an Alexa Toolbar. - userAgent.contains("Alexa Toolbar") # This is not released, even Windows 11 calls itself Windows 10 - userAgent.contains("Windows NT 11.0") # iPods are not in common use - userAgent.contains("iPod")(4)匹配客户端IP/usr/share/doc/anubis/data/clients/mistral-mistralai-user.yaml# Acts on behalf of user requests # https://docs.mistral.ai/robots/ - name: mistral-mistralai-user user_agent_regex: MistralAI-User/.+; \+https\://docs\.mistral\.ai/robots action: ALLOW # https://mistral.ai/mistralai-user-ips.json remote_addresses: [ "20.240.160.161/32", "20.240.160.1/32", ](5)匹配GEOIP- name: countries-with-aggressive-scrapers action: WEIGH geoip: countries: - BR - CN weight: adjust: 10(6)匹配ASN- name: aggressive-asns-without-functional-abuse-contact action: WEIGH asns: match: - 13335 # Cloudflare - 136907 # Huawei Cloud - 45102 # Alibaba Cloud weight: adjust: 10(7)匹配后动作动作 解释ALLOW 允许,跳过后续所有检查DENY 拒绝访问CHALLENGE 进行客户端挑战WEIGH 修改请求权重ALLOW和DENY不再解释2)CHALLENGE- name: generic-bot-catchall user_agent_regex: (?i:bot|crawler) action: CHALLENGE challenge: difficulty: 16 # impossible report_as: 4 # lie to the operator algorithm: slow # intentionally waste CPU cycles and timename:名称,可自定义user_agent_regex:正则表达式匹配User-Agentaction:动作,立即进行客户端挑战challenge:客户端挑战配置difficulty:难度,16 表示计算出的hash值前 16 位为 0,不可能完成(比特币的前导 0 个数为 19-20),在客户端完成 16 为的计算可能需要几万年甚至更久(攻击者看者 99%的CPU陷入沉思)report_as:用户在界面上看到的难度数值(你甚至可以骗他,这个进度条怎么一直卡在 99%不走呢)algorithm:采用的Hash算法,slow故意折磨CPU3)WEIGH调整请求的权重,正数为增加权重,负数为减少权重,后续会进入到 thresholds 中,针对不同的请求设置不同的CHALLENGE0-10 的权重,进行快速算法,几乎不需要等待- name: mild-suspicion expression: all: - weight > 0 - weight < 10 action: CHALLENGE challenge: algorithm: metarefresh difficulty: 2 report_as: 24)其他根据服务器负载动态调整示例在配置文件中已给出,有需要可以启用 # ## System load based checks. # # If the system is under high load, add weight. # - name: high-load-average # action: WEIGH # expression: load_1m >= 10.0 # make sure to end the load comparison in a .0 # weight: # adjust: 20 ## If your backend service is running on the same operating system as Anubis, ## you can uncomment this rule to make the challenge easier when the system is ## under low load. ## ## If it is not, remove weight. # - name: low-load-average # action: WEIGH # expression: load_15m <= 4.0 # make sure to end the load comparison in a .0 # weight: # adjust: -10 -

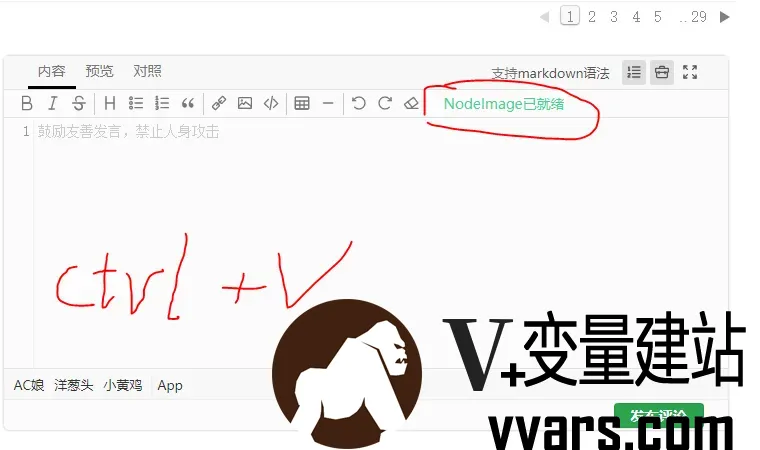

免费图床新选择——托管在cnfaster和dreamecloud的免费图床nodeimage发布,附带nodeseek论坛内自动上传图片脚本 一 前言nodeimage有nodeseek管理shuai大佬,图床定位为 NS 官方专用图床,已全面接入到 NS 编辑器 中,实现粘贴照片即可使用。图床特色:仅供nodeseek用户使用,需要nodeseek账号授权10T储存,不怕塞满有一些可自定义的设置功能二、图床特色1 安全与权限升级1)严格文件验证:实现文件头魔数检测,确保上传内容与声明类型一致,杜绝伪装文件2)API鉴权完善:修复认证机制,确保API访问安全可靠3)用户上传配额:根据用户等级设置差异化上传限制:1级用户 20张/天2级用户 40张/天3级用户 70张/天4级用户 110张/天5级用户 160张/天6级用户 220张/天4) 多设备登录:支持最多10台设备同时在线,告别单点登录限制2 架构全面优化1)三域名分离部署:前端、API后端、图片服务完全分离,提升安全性和CDN效果2)安全ID生成机制:升级到V4版本签名算法,全面防止被恶意脚本扫刷图片3)URL结构优化:移除URL中的用户ID,增强隐私保护4)重构管理后台,方便审查图片和用户5)新增每日异地备份,不会出现丢失图片的情况3 功能显著增强1)格式支持扩展:新增SVG和AVIF格式支持,并实现SVG安全过滤2)动图处理优化:智能识别动图,避免错误压缩为静态图片3)NSFW检测调优:优化检测阈值,减少误判率4)缩略图系统:自动生成多尺寸WebP缩略图,页面加载速度提升80-95%5)过期图片自动清理:每日午夜自动清理过期内容,无需人工干预4 用户体验提升1)图片查看器升级:实现全新交互体验,支持鼠标滚轮缩放、拖动平移、滑块精确控制2)暗色模式:全新暗色主题,支持系统主题自动切换3)批量复制功能:批量上传后一键复制所有图片代码,支持多种格式切换4)全新管理面板:后台界面全面重构,美观易用5)品牌视觉优化:独立品牌logo,专业且易识别6)设置按钮可发现性:添加引导动画和工具提示,帮助新用户发现功能7)网站页脚完善:添加版权信息、使用条款、隐私政策等内容三 使用说明虽然这确实是Nodeseek官方的图床,但是考虑到完全集成到论坛编辑器内,论坛的代码改动会比较大,作者写了个油猴脚本,实现nodeseek编辑器的三种图片上传方式1)点击图片按钮上传2)拖拽上传3)粘贴上传1 安装插件需要在chrome内核的浏览器,比如谷歌chrome或者微软的edge,先安装油猴或者暴力猴,再安装nodeimage扩展即可,脚本链接:https://greasyfork.org/zh-CN/scripts/542011-nodeimage图片上传助手。2 使用1 在nodeseek论坛使用如果你只想用在nodeseek论坛,完全不需要打开nodeimage,直接加载脚本就好了,剩下的全自动的,选中需要的照片,然后Ctrl+C复制,在nodeseek论坛直接粘贴就好了.2 非nodeseek论坛使用将nodeimage作为免费图床使用,直接访问nodeimage.com即可。

免费图床新选择——托管在cnfaster和dreamecloud的免费图床nodeimage发布,附带nodeseek论坛内自动上传图片脚本 一 前言nodeimage有nodeseek管理shuai大佬,图床定位为 NS 官方专用图床,已全面接入到 NS 编辑器 中,实现粘贴照片即可使用。图床特色:仅供nodeseek用户使用,需要nodeseek账号授权10T储存,不怕塞满有一些可自定义的设置功能二、图床特色1 安全与权限升级1)严格文件验证:实现文件头魔数检测,确保上传内容与声明类型一致,杜绝伪装文件2)API鉴权完善:修复认证机制,确保API访问安全可靠3)用户上传配额:根据用户等级设置差异化上传限制:1级用户 20张/天2级用户 40张/天3级用户 70张/天4级用户 110张/天5级用户 160张/天6级用户 220张/天4) 多设备登录:支持最多10台设备同时在线,告别单点登录限制2 架构全面优化1)三域名分离部署:前端、API后端、图片服务完全分离,提升安全性和CDN效果2)安全ID生成机制:升级到V4版本签名算法,全面防止被恶意脚本扫刷图片3)URL结构优化:移除URL中的用户ID,增强隐私保护4)重构管理后台,方便审查图片和用户5)新增每日异地备份,不会出现丢失图片的情况3 功能显著增强1)格式支持扩展:新增SVG和AVIF格式支持,并实现SVG安全过滤2)动图处理优化:智能识别动图,避免错误压缩为静态图片3)NSFW检测调优:优化检测阈值,减少误判率4)缩略图系统:自动生成多尺寸WebP缩略图,页面加载速度提升80-95%5)过期图片自动清理:每日午夜自动清理过期内容,无需人工干预4 用户体验提升1)图片查看器升级:实现全新交互体验,支持鼠标滚轮缩放、拖动平移、滑块精确控制2)暗色模式:全新暗色主题,支持系统主题自动切换3)批量复制功能:批量上传后一键复制所有图片代码,支持多种格式切换4)全新管理面板:后台界面全面重构,美观易用5)品牌视觉优化:独立品牌logo,专业且易识别6)设置按钮可发现性:添加引导动画和工具提示,帮助新用户发现功能7)网站页脚完善:添加版权信息、使用条款、隐私政策等内容三 使用说明虽然这确实是Nodeseek官方的图床,但是考虑到完全集成到论坛编辑器内,论坛的代码改动会比较大,作者写了个油猴脚本,实现nodeseek编辑器的三种图片上传方式1)点击图片按钮上传2)拖拽上传3)粘贴上传1 安装插件需要在chrome内核的浏览器,比如谷歌chrome或者微软的edge,先安装油猴或者暴力猴,再安装nodeimage扩展即可,脚本链接:https://greasyfork.org/zh-CN/scripts/542011-nodeimage图片上传助手。2 使用1 在nodeseek论坛使用如果你只想用在nodeseek论坛,完全不需要打开nodeimage,直接加载脚本就好了,剩下的全自动的,选中需要的照片,然后Ctrl+C复制,在nodeseek论坛直接粘贴就好了.2 非nodeseek论坛使用将nodeimage作为免费图床使用,直接访问nodeimage.com即可。 -

将免费进行到底——为 Alice IPv6 免费鸡添加官方 IPv4 出口 | tun2socks 的 sing-box 实现 一 前言众所周知,Alice IPv6 免费鸡只有 IPv6 并没有 IPv4 出口,要用爽的话还得添加 IPv4 出口但总不能总依靠 CF 大善人的 warp 吧?家人们总还是要吃点好的(但 Alice 大善人提供了5个 Socks5 出口,我们可以利用它,把 socks5 代理作为本机的 IPv4 出口!不过本次教程不会教大家简单的添加一个 socks5 出站,而是教大家添加tun网卡,实现 tun to socks!二 安装教程闲言少叙,正片开始!1. 安装并配置 sing-boxsing-box 提供了一键脚本可以一键安装:curl -fsSL https://sing-box.app/install.sh | sh验证是否正确安装:sing-box version有输出就算安装啦~ sing-box version 1.11.14 Environment: go1.24.4 linux/amd64 Tags: with_gvisor,with_quic,with_dhcp,with_wireguard,with_utls,with_reality_server,with_acme,with_clash_api,with_ech Revision: 9b8ab3e61e5b3a199fce5575bc6a04373f222d22 CGO: disabled或者可以使用 sing-box 官方提供的其他安装方法2. 配置 sing-box (tun2socks)编辑 sing-box 配置文件在 /etc/sing-box/config.json 里添加以下配置: { "log": { "disabled": true, //关闭日志(隐私考虑) "level": "info" }, "inbounds": [ { // 添加 tun 入站 "type": "tun", "tag": "tun-in", "address": ["172.16.0.1/30", "fdfe:dcba:9876::1/126"], "route_exclude_address": "::/0", //排除所有 IPv6 路由(非常重要!) "mtu": 1492, "auto_route": true, "strict_route": false, //严格模式关掉,以便正常流量通过(也很重要!) "stack": "mixed", } ], "outbounds": [ { //添加 socks5 出站(默认使用第一个出站) "type": "socks", "tag": "socks-out", "server": "2a14:67c0:116::1", "server_port": 20000, //更改端口变更出站节点 "version": "5", "username": "alice", "password": "alicefofo123..OVO", "bind_interface": "eth0" //绑定接口防止回环 }, { "type": "direct", "tag": "direct-out", "bind_interface": "eth0" //绑定接口防止回环 } ], "route": { "auto_detect_interface": true, //自动侦测接口防止回环 "rules": [ { //添加 IPv6 规则,增加鲁棒性 "ip_version": 6, "outbound": "direct-out" } ] } }我这里只提供了一个比较基础的模版,有实力的话可以自己写更多~重启 sing-box:systemctl restart sing-box这里可以验证一下是否真的成功:curl api.ipify.org返回:112.120.48.210有输出 IPv4 就算成功啦~如果发现进不了SSH,一定就是没有配置排除路由(route_exclude_address)导致的!这样的话也只能进入 Alice 的 VNC 后台去把 sing-box 关掉了 :(命令:systemctl stop sing-box如果一切没问题的话,那就可以设置开机自启动:systemctl enable sing-box这样就大功告成啦~3. 享受~至此,你已经通过 sing-box 实现 tun2socks !然后就可以随便想访问 IPv6 就访问 IPv6,想访问 IPv4 就访问 IPv4 啦!三、后言实际上可以使用现成的 tun2socks ,但为什么不用它?因为配置起来太复杂,要手动添加tun虚拟网卡,还要手动配置路由,就很麻烦,最后发现果然还是 sing-box 这种一体式的管理比较方便,也适合我们这种懒人

将免费进行到底——为 Alice IPv6 免费鸡添加官方 IPv4 出口 | tun2socks 的 sing-box 实现 一 前言众所周知,Alice IPv6 免费鸡只有 IPv6 并没有 IPv4 出口,要用爽的话还得添加 IPv4 出口但总不能总依靠 CF 大善人的 warp 吧?家人们总还是要吃点好的(但 Alice 大善人提供了5个 Socks5 出口,我们可以利用它,把 socks5 代理作为本机的 IPv4 出口!不过本次教程不会教大家简单的添加一个 socks5 出站,而是教大家添加tun网卡,实现 tun to socks!二 安装教程闲言少叙,正片开始!1. 安装并配置 sing-boxsing-box 提供了一键脚本可以一键安装:curl -fsSL https://sing-box.app/install.sh | sh验证是否正确安装:sing-box version有输出就算安装啦~ sing-box version 1.11.14 Environment: go1.24.4 linux/amd64 Tags: with_gvisor,with_quic,with_dhcp,with_wireguard,with_utls,with_reality_server,with_acme,with_clash_api,with_ech Revision: 9b8ab3e61e5b3a199fce5575bc6a04373f222d22 CGO: disabled或者可以使用 sing-box 官方提供的其他安装方法2. 配置 sing-box (tun2socks)编辑 sing-box 配置文件在 /etc/sing-box/config.json 里添加以下配置: { "log": { "disabled": true, //关闭日志(隐私考虑) "level": "info" }, "inbounds": [ { // 添加 tun 入站 "type": "tun", "tag": "tun-in", "address": ["172.16.0.1/30", "fdfe:dcba:9876::1/126"], "route_exclude_address": "::/0", //排除所有 IPv6 路由(非常重要!) "mtu": 1492, "auto_route": true, "strict_route": false, //严格模式关掉,以便正常流量通过(也很重要!) "stack": "mixed", } ], "outbounds": [ { //添加 socks5 出站(默认使用第一个出站) "type": "socks", "tag": "socks-out", "server": "2a14:67c0:116::1", "server_port": 20000, //更改端口变更出站节点 "version": "5", "username": "alice", "password": "alicefofo123..OVO", "bind_interface": "eth0" //绑定接口防止回环 }, { "type": "direct", "tag": "direct-out", "bind_interface": "eth0" //绑定接口防止回环 } ], "route": { "auto_detect_interface": true, //自动侦测接口防止回环 "rules": [ { //添加 IPv6 规则,增加鲁棒性 "ip_version": 6, "outbound": "direct-out" } ] } }我这里只提供了一个比较基础的模版,有实力的话可以自己写更多~重启 sing-box:systemctl restart sing-box这里可以验证一下是否真的成功:curl api.ipify.org返回:112.120.48.210有输出 IPv4 就算成功啦~如果发现进不了SSH,一定就是没有配置排除路由(route_exclude_address)导致的!这样的话也只能进入 Alice 的 VNC 后台去把 sing-box 关掉了 :(命令:systemctl stop sing-box如果一切没问题的话,那就可以设置开机自启动:systemctl enable sing-box这样就大功告成啦~3. 享受~至此,你已经通过 sing-box 实现 tun2socks !然后就可以随便想访问 IPv6 就访问 IPv6,想访问 IPv4 就访问 IPv4 啦!三、后言实际上可以使用现成的 tun2socks ,但为什么不用它?因为配置起来太复杂,要手动添加tun虚拟网卡,还要手动配置路由,就很麻烦,最后发现果然还是 sing-box 这种一体式的管理比较方便,也适合我们这种懒人 -

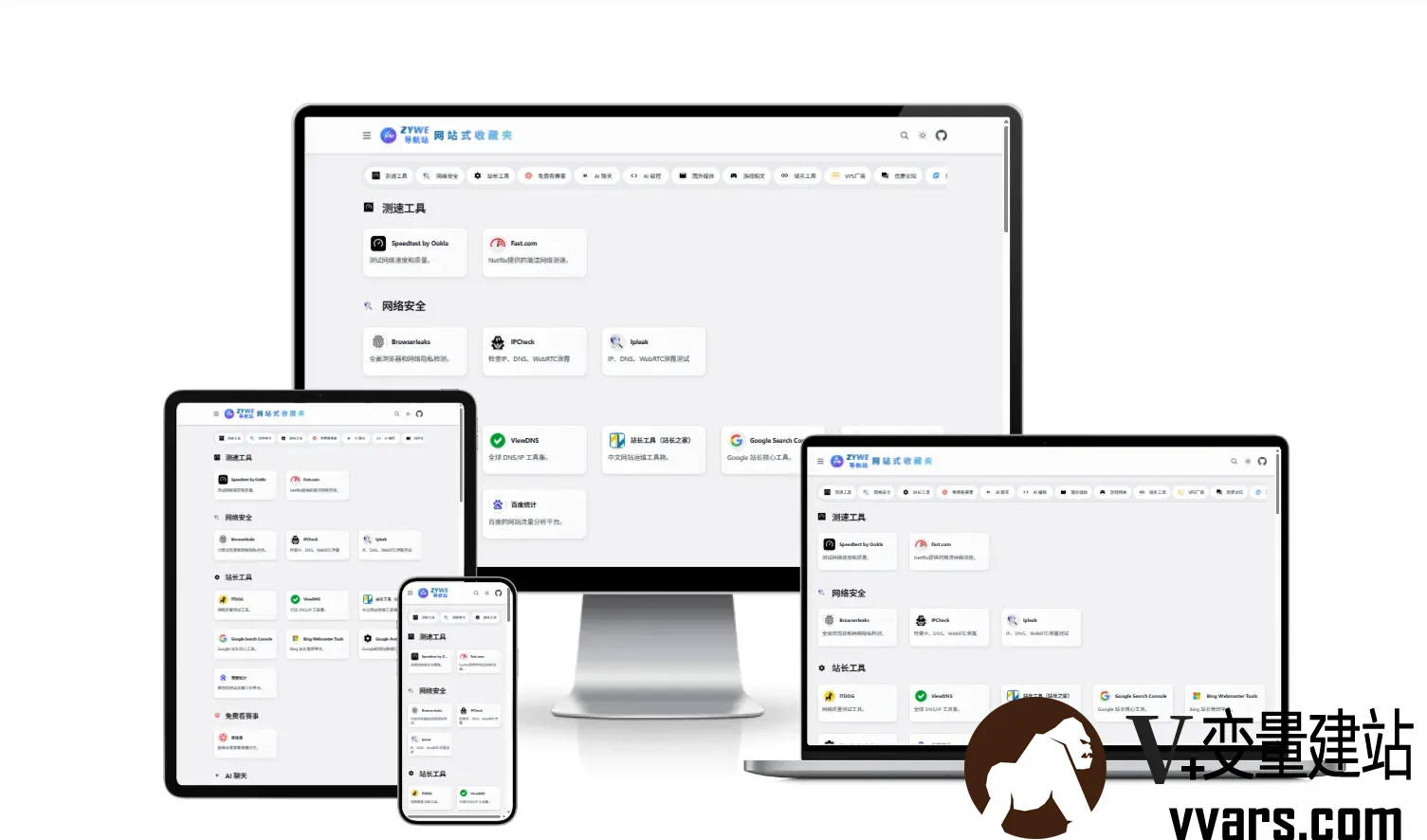

适合"养老"的网站收藏夹导航——基于Astro的导航站主题,支持 Vercel 和 Cloudflare Pages一键部署 1 前言源码来源于Nodeseek的zywe,源码地址。演示地址:dh.zywe.de关于xwnav-theme源码的简介:人人都能搭建的简洁美观收藏夹网站。不仅仅是简单的链接集合,更是智能化的导航平台,让您只需专注于内容管理而非技术细节,**只需编辑一个数据文件,所有功能都会自动更新,极大简化了维护工作,打包后部署超轻量化(1-2mb)。🌟 独特优势🤖 自动化功能,让您只需专注于内容管理而非技术细节,只需修改一个数据文件(src/data/navLinks.js),所有功能都会自动更新,极大简化了维护工作自动化功能🖼️ 自动图标获取:添加新网站和新分类时无需手动下载图标,脚本自动获取并优化图标引用图标一条龙📑 自动分类导航:侧边栏分类导航会根据数据文件自动更新,无需手动修改HTML🔎 自动搜索索引:搜索功能会自动检测新增网站和分类,无需额外配置🃏 自动卡片生成:网站卡片布局会自动适应新增内容,保持一致的视觉效果🎨 自动主题切换:根据用户系统配置自动切换暗色/亮色主题🧹 自动清理图标:图标管理脚本会自动清理未使用的图标文件,保持项目整洁📱 自动响应式适配:无需编写额外代码,完美适配各种设备屏幕🗺️ 自动生成站点地图:每次构建项目自动生成robots.txt和sitemap.xml📝 自动SEO元数据:每次构建项目自动生成和管理SEO相关的元标签等等代码🟢灯塔PageSpeed Insights2🌈 主要特点🏷 简洁直观的界面:分类清晰,操作便捷🔍 智能搜索功能:快速查找您需要的网站📎 双分类导航栏:主页横向导航+侧边导航📃 卡片式网站展示:直观美观,一目了然🔄 自动化工作流:减少手动操作,提高效率🌓 暗色模式:智能切换暗色/亮色模式⏱️ 快速返回顶部:一键回到顶部的便捷按钮🚀 快速加载:基于Astro框架构建,性能卓越📸 图片懒加载:提升加载速度和用户体验🔊 流畅的动画过渡:提升用户界面交互体验💻 智能顶部栏: 上滑展出,下滑收缩不挡视野🙌 人性化设计: 搜索框侧边栏可点空白处退出🌤️ 实时天气显示:集成API实时获取当地天气📱 响应式布局:适配所有设备屏幕🔒 无需数据库:纯静态设计,无需数据库🔑 隐藏链接地址:悬停在卡片,不显示链接地址💾 Island岛屿架构按需加载:动态组件独立渲染,提升加载速度静态首屏:首屏纯静态生成,并行加载交互组件延迟水合:交互元素延迟水合,减少首屏阻塞查询优先:搜索和导航操作优先渲染浏览器缓存:利用存储机制优化重复访问3🎶 部署教程推荐:本地Windows开发 + Linux服务器部署:本地开发和构建,仅将执行构建命令后的dist目录部署到服务器3.1 git 拉取git clone https://github.com/zywe03/astro-nav-theme.git(或者下载压缩包源码解压)3.2 windowns安装Node.js 环境安装 Node.js 18.0+ (推荐LTS版本)官网Windows用户:直接从官网下载安装包3.3 包管理器选择启用 pnpm(轻量、高效)corepack enable corepack prepare pnpm@latest --activate3.4 开始安装# 安装依赖 pnpm i # 浏览器实时看效果 pnpm dev # 自动下载图标 npx tsx .\icon-system\0icon.ts # 打包构建生成/dist目录 pnpm build3.5 上传/dist目录到服务器,nginx反代4 借助AI导入导航数据第一次导入大量网址链接,借助AI快速生成网站导航内容(强烈建议)列出想要生成的网站所属分类,名称或网站,短和长描述让AI生成,节省工作量AI提示词:统一分类opensource 网站: github baidu.com 谷歌 具体按照以下样式生成,使用“JavaScript风格格式+单引号”,不要添加"icon字段"和"[]"" { id: 'github', title: 'GitHub', description: '全球最大的开源代码托管平台,支持 Git 版本控制,适用于协作开发、项目管理和自动化工作流,是开发者共享与协作的核心工具。' shortDesc: '代码托管平台。', url: 'https://github.com/', category: 'opensource', }, 描述根据网站实际内容,专业,准确,介绍背景独特优势等等,不要太刻板,臃肿,重复插入数据文件navLinks.js后 执行npx tsx .\icon-system\0icon.ts自动下载图标,即可完成,大量导航网站导入5 💬 日常使用关键文件和目录说明5.1 核心数据文件src/data/navLinks.js: 存储所有网站数据和分类信息,是最常修改的文件,包含网站信息和分类定义5.2 图标存储public/icons/: 存储所有网站图标public/icons/category/: 存储分类图标public/icons/downloaded_sites/: 临时下载目录(自动清理)public/icons/downloaded_categories/: 临时下载目录(自动清理)5.3 📝 增删网站和分类修改 src/data/navLinks.js 文件即可管理所有网站和分类建议统一用一种格式JavaScript风格格式+单引号,避免脚本错误识别5.3.1 添加新分类在 categories 数组中添加新分类:⚠️ 注意:不要手动添加icon字段,不要icon""字段留空,都会导致图标无法自动下载添加icon字段,手动自定义图标除外export const categories = [ // 分类注释 { id: new, //分类ID name: '新分类名称',icon: '/icons/category/new-category.svg' // 分类图标也支持自动生成,基于name的首字生成 } ];5.3.2 添加新网站在 sites 数组中添加新网站:export const sites = [ { id: 'github', // 网站ID title: 'GitHub', // 网站名称 description: '全球最大代码托管平台。', // 网站描述 shortDesc: '代码托管平台。', // 简短描述 url: 'https://github.com/', // 网站链接(包含完整协议(`http://`或`https://`)) category: 'opensource', // 所属分类 ID(必须对应分类中的id) // 注意:不需要添加icon字段,脚本会自动处理 }, ];5.3.3 网站和分类排序一句话调顺序即可分类排序: 调整 categories 数组中分类的顺序即可改变分类的显示顺序网站排序: 调整 sites 数组中网站的顺序即可改变网站的显示顺序生成后插入navLinks.js即可5.4 🖼️ 图标下载脚本使用指南✅ navLinks.js使用“JavaScript风格格式+单引号”,不要添加"icon字段" 由于是静态网站,建议全部图标在构建时下载图标引用使用步骤:首先在 src/data/navLinks.js 中添加好新网站或分类一键执行:# 终端复制粘贴回车 npx tsx .\icon-system\0icon.ts5.5 🔗 修改友情链接和按钮✅使用vscode搜索文本记得修改可快速找到全部需要自定义的内容(强烈建议搜索)5.5.1 修改友情链接和页脚声明位于页脚组件中,修改 src/components/Footer.astro 文件:点开文件一目了然5.5.2 修改网站大标题(名称)和logo修改src\components\LogoName.astro独立出来方便修改,点开文件一目了然5.5.3 修改全部图标default.svg导航网站三级回退机制保底图标logo.png网站社交媒体分享图片logo.svg网站主图标准备您的图标文件(修改图片,但使用固定命名)替换图标文件放入 public\images 目录即可5.5.4 提交站点地图只需要向搜索引擎提交 https://xxx.com/sitemap-index.xml 这一个文件

适合"养老"的网站收藏夹导航——基于Astro的导航站主题,支持 Vercel 和 Cloudflare Pages一键部署 1 前言源码来源于Nodeseek的zywe,源码地址。演示地址:dh.zywe.de关于xwnav-theme源码的简介:人人都能搭建的简洁美观收藏夹网站。不仅仅是简单的链接集合,更是智能化的导航平台,让您只需专注于内容管理而非技术细节,**只需编辑一个数据文件,所有功能都会自动更新,极大简化了维护工作,打包后部署超轻量化(1-2mb)。🌟 独特优势🤖 自动化功能,让您只需专注于内容管理而非技术细节,只需修改一个数据文件(src/data/navLinks.js),所有功能都会自动更新,极大简化了维护工作自动化功能🖼️ 自动图标获取:添加新网站和新分类时无需手动下载图标,脚本自动获取并优化图标引用图标一条龙📑 自动分类导航:侧边栏分类导航会根据数据文件自动更新,无需手动修改HTML🔎 自动搜索索引:搜索功能会自动检测新增网站和分类,无需额外配置🃏 自动卡片生成:网站卡片布局会自动适应新增内容,保持一致的视觉效果🎨 自动主题切换:根据用户系统配置自动切换暗色/亮色主题🧹 自动清理图标:图标管理脚本会自动清理未使用的图标文件,保持项目整洁📱 自动响应式适配:无需编写额外代码,完美适配各种设备屏幕🗺️ 自动生成站点地图:每次构建项目自动生成robots.txt和sitemap.xml📝 自动SEO元数据:每次构建项目自动生成和管理SEO相关的元标签等等代码🟢灯塔PageSpeed Insights2🌈 主要特点🏷 简洁直观的界面:分类清晰,操作便捷🔍 智能搜索功能:快速查找您需要的网站📎 双分类导航栏:主页横向导航+侧边导航📃 卡片式网站展示:直观美观,一目了然🔄 自动化工作流:减少手动操作,提高效率🌓 暗色模式:智能切换暗色/亮色模式⏱️ 快速返回顶部:一键回到顶部的便捷按钮🚀 快速加载:基于Astro框架构建,性能卓越📸 图片懒加载:提升加载速度和用户体验🔊 流畅的动画过渡:提升用户界面交互体验💻 智能顶部栏: 上滑展出,下滑收缩不挡视野🙌 人性化设计: 搜索框侧边栏可点空白处退出🌤️ 实时天气显示:集成API实时获取当地天气📱 响应式布局:适配所有设备屏幕🔒 无需数据库:纯静态设计,无需数据库🔑 隐藏链接地址:悬停在卡片,不显示链接地址💾 Island岛屿架构按需加载:动态组件独立渲染,提升加载速度静态首屏:首屏纯静态生成,并行加载交互组件延迟水合:交互元素延迟水合,减少首屏阻塞查询优先:搜索和导航操作优先渲染浏览器缓存:利用存储机制优化重复访问3🎶 部署教程推荐:本地Windows开发 + Linux服务器部署:本地开发和构建,仅将执行构建命令后的dist目录部署到服务器3.1 git 拉取git clone https://github.com/zywe03/astro-nav-theme.git(或者下载压缩包源码解压)3.2 windowns安装Node.js 环境安装 Node.js 18.0+ (推荐LTS版本)官网Windows用户:直接从官网下载安装包3.3 包管理器选择启用 pnpm(轻量、高效)corepack enable corepack prepare pnpm@latest --activate3.4 开始安装# 安装依赖 pnpm i # 浏览器实时看效果 pnpm dev # 自动下载图标 npx tsx .\icon-system\0icon.ts # 打包构建生成/dist目录 pnpm build3.5 上传/dist目录到服务器,nginx反代4 借助AI导入导航数据第一次导入大量网址链接,借助AI快速生成网站导航内容(强烈建议)列出想要生成的网站所属分类,名称或网站,短和长描述让AI生成,节省工作量AI提示词:统一分类opensource 网站: github baidu.com 谷歌 具体按照以下样式生成,使用“JavaScript风格格式+单引号”,不要添加"icon字段"和"[]"" { id: 'github', title: 'GitHub', description: '全球最大的开源代码托管平台,支持 Git 版本控制,适用于协作开发、项目管理和自动化工作流,是开发者共享与协作的核心工具。' shortDesc: '代码托管平台。', url: 'https://github.com/', category: 'opensource', }, 描述根据网站实际内容,专业,准确,介绍背景独特优势等等,不要太刻板,臃肿,重复插入数据文件navLinks.js后 执行npx tsx .\icon-system\0icon.ts自动下载图标,即可完成,大量导航网站导入5 💬 日常使用关键文件和目录说明5.1 核心数据文件src/data/navLinks.js: 存储所有网站数据和分类信息,是最常修改的文件,包含网站信息和分类定义5.2 图标存储public/icons/: 存储所有网站图标public/icons/category/: 存储分类图标public/icons/downloaded_sites/: 临时下载目录(自动清理)public/icons/downloaded_categories/: 临时下载目录(自动清理)5.3 📝 增删网站和分类修改 src/data/navLinks.js 文件即可管理所有网站和分类建议统一用一种格式JavaScript风格格式+单引号,避免脚本错误识别5.3.1 添加新分类在 categories 数组中添加新分类:⚠️ 注意:不要手动添加icon字段,不要icon""字段留空,都会导致图标无法自动下载添加icon字段,手动自定义图标除外export const categories = [ // 分类注释 { id: new, //分类ID name: '新分类名称',icon: '/icons/category/new-category.svg' // 分类图标也支持自动生成,基于name的首字生成 } ];5.3.2 添加新网站在 sites 数组中添加新网站:export const sites = [ { id: 'github', // 网站ID title: 'GitHub', // 网站名称 description: '全球最大代码托管平台。', // 网站描述 shortDesc: '代码托管平台。', // 简短描述 url: 'https://github.com/', // 网站链接(包含完整协议(`http://`或`https://`)) category: 'opensource', // 所属分类 ID(必须对应分类中的id) // 注意:不需要添加icon字段,脚本会自动处理 }, ];5.3.3 网站和分类排序一句话调顺序即可分类排序: 调整 categories 数组中分类的顺序即可改变分类的显示顺序网站排序: 调整 sites 数组中网站的顺序即可改变网站的显示顺序生成后插入navLinks.js即可5.4 🖼️ 图标下载脚本使用指南✅ navLinks.js使用“JavaScript风格格式+单引号”,不要添加"icon字段" 由于是静态网站,建议全部图标在构建时下载图标引用使用步骤:首先在 src/data/navLinks.js 中添加好新网站或分类一键执行:# 终端复制粘贴回车 npx tsx .\icon-system\0icon.ts5.5 🔗 修改友情链接和按钮✅使用vscode搜索文本记得修改可快速找到全部需要自定义的内容(强烈建议搜索)5.5.1 修改友情链接和页脚声明位于页脚组件中,修改 src/components/Footer.astro 文件:点开文件一目了然5.5.2 修改网站大标题(名称)和logo修改src\components\LogoName.astro独立出来方便修改,点开文件一目了然5.5.3 修改全部图标default.svg导航网站三级回退机制保底图标logo.png网站社交媒体分享图片logo.svg网站主图标准备您的图标文件(修改图片,但使用固定命名)替换图标文件放入 public\images 目录即可5.5.4 提交站点地图只需要向搜索引擎提交 https://xxx.com/sitemap-index.xml 这一个文件 -

![[MV]-林俊杰-裂缝中的阳光——真正的牢笼在心间:《裂缝中的阳光》与穿透铁窗的灵魂救赎](https://www.vvars.com/usr/themes/Joe/assets/img/lazyload.jpg) [MV]-林俊杰-裂缝中的阳光——真正的牢笼在心间:《裂缝中的阳光》与穿透铁窗的灵魂救赎 [MV]-林俊杰-真正的牢笼在心间:《裂缝中的阳光》与穿透铁窗的灵魂救赎《裂缝中的阳光》是首慢板的节奏蓝调作品,由吴青峰亲自填词,林俊杰作曲、编曲兼制作 。于创作方面,这首歌没有选择林俊杰以往情歌的主题,而是将歌曲立意设定在了传递励志的正能量上。旨在提醒那些处于逆境中的人们,要拿出勇气面对心中的裂痕,不要忘记初衷,不要轻言放弃。林俊杰在演唱《裂缝中的阳光》时,感性地谈到,歌迷就是他的“裂缝中的阳光” 。该曲名为《裂缝中的阳光》,然而在每个裂缝中之所以会散落阳光,是因为阳光在每个裂缝中散落实质体现的是胶体的丁达尔效应。一、歌曲简介《裂缝中的阳光》是林俊杰演唱的节奏蓝调歌曲,由吴青峰填词,林俊杰谱曲,收录于林俊杰2013年3月13日发行的专辑《因你而在》中。《裂缝中的阳光》是首慢板的节奏蓝调作品,旨在提醒于逆境中的人们不忘初衷、不言放弃。歌词部分一字一句都在提醒每个人要拿出勇气面对心中的裂痕,不要害怕面对心中怀疑、自我挫败的声响。而林俊杰在演唱《裂缝中的阳光》时也感性地称,歌迷就是他的“裂缝中的阳光” 。2013年4月25日,林俊杰于2012年度中国TOP排行榜颁奖晚会中演唱了歌曲。二、MV欣赏{dplayer src="https://www.vvars.com/tools/mv/MV-JJLin-lfzdyg.webm"/}三、解读感悟耳机里,林俊杰的声线像一道温热的血流,注入冰冷僵硬的躯体。那句“心脏没有那么脆弱,总还会有执着”,在铁窗回音壁间反复碰撞后,最终锤击在灵魂最深处——原来,裂痕最深之处,恰是光最决意刺入之地。这首歌的疗愈力量,在监狱的布景下,展现出更锋利、也更普世的救赎意义。歌曲的诞生饱含深意。林俊杰目睹亲友与抑郁症(内心的牢笼)抗争的经历,催生了他创作此曲的冲动。他想告诉身处黑暗的人们:即使被有形或无形的枷锁困住,你灵魂深处不屈的回响,总会被听见。MV极具象化地选择了监狱——人类社会最极端的物理禁锢符号——来承载这个隐喻,直指核心:我们每个人心中,都可能囚禁着一个渴望自由却不得其门的囚徒。冰冷的规训与微弱的心光:MV开篇,铁栏切割视角,灰色天光吝啬地洒在放风场。囚犯们穿着统一编号的囚服,行走在网格般切割的水泥地上——这是失去个体性的终极形态。雨水从天而降,淋湿身体,如同无法控制命运的无情冲刷。然而,当镜头拉近特写,我们看到一个囚徒(主角)眼中死寂的深处,并非全然的空洞。当《裂缝中的阳光》旋律响起,他独自站在雨中,手掌伸向灰蒙天际,接住的不是雨水,仿佛是从云层裂缝中漏下的、有温度的光。琴键如何敲碎铁石?音乐如何凿通心墙?MV中极具象征意义的一幕:林俊杰身处牢房之内,专注弹奏一架黑色钢琴。音乐,这无形的、看似柔软的力量,竟成为穿透厚重砖墙与冰冷铁栏的媒介。它不是越狱的工具,而是心狱的解码器。琴键每一次落下,都在敲击着墙壁禁锢下的灵魂壁垒。那些音符如凿子,试图在心灵岩层上凿开一道细微裂缝。阳光非从物理的牢房裂缝射入(监狱的窗是铁栏,本无“玻璃裂缝”可言),而是当内心壁垒被撼动时,希望得以照进的路径。“等到黑夜翻面之后,会是新的白昼”:救赎在墙外,更在心底这不是廉价的“出狱即重生”。MV结局:主角终于刑满释放,蹒跚走出巨大的铁门。刺目的阳光瞬间将他淹没,他本能地用手挡眼,身体在自由中显得有些踉跄和恍惚——他还不习惯这被归还的光明。这一幕充满深意:身体的自由需要适应,心灵的解冻更非一蹴而就。真正的“新白昼”,不仅是物理空间的转换,更是心灵如何适应和拥抱这久违的光芒。“翻面”的不仅是黑夜,是被铁栏切割的过去视角,更是看待自己与世界的心境。重思“裂缝”与“牢笼”:我们皆在挣脱的路上MV的监狱场景赋予这首歌更凝重的现实感与普适性:可见与不可见的牢笼: 铁窗是枷锁的显性符号,但焦虑、抑郁、失败感、无望的重复……这些是更广泛存在却隐形的“心牢”。歌曲提醒我们:识别心牢的存在,是破壁的第一步。缝隙由自内而外的力量撬开: 光虽在“外”,但裂缝的生成,源于内心生出的那一点“执着”,是伸出手去触碰的意愿(如囚徒仰望雨空),是与穿透性的力量(音乐、信念、支持)产生共振的勇气。内里不松动,外光无法渗入。“出狱”后的漫长功课: 走出有形或无形的牢笼只是起点。在自由中的“踉跄”,恰恰证明了伤痕的存在与重塑之路的漫长。歌词给予的是长跑者的抚慰:光已在,你只是需要时间让瞳孔重新聚焦。这首歌的终极力量并非仅仅告诉人们光明必至。它通过监狱的极端语境,撕开一个更深刻的真相:最坚固的牢狱,往往由我们自己的恐惧、绝望或自我否定浇筑在心间。真正的“越狱”,始于承认被困,并允许哪怕一丝微光,敲打那看似坚不可摧的壁垒。灵魂裂缝初现之处,正是救赎开始蔓延的微光小径。四、歌曲歌词:有多少创伤卡在咽喉 有多少眼泪滴湿枕头 有多少你觉得不能够 被懂的痛只能沉默 有多少夜晚没有尽头 有多少的寂寞无人诉说 有多少次的梦还没做 已成空 等到黑夜翻面之后 会是新的白昼 等到海啸退去之后 只是潮起潮落 别到最后你才发觉 心里头的野兽 还没到最终就已经罢休 心脏没有那么脆弱 总还会有执着 人生不会只有收获 总难免有伤口 不要害怕生命中 不完美的角落 阳光在每个裂缝中散落 就算一切重来又怎样 让你的心在我心上跳动 每个逐渐暗下来的夜 一起走过 等到黑夜翻面之后 会是新的白昼 等到海啸退去之后 只是潮起潮落 别到最后你才发觉 心里头的野兽 还没到最终就已经罢休 心脏没有那么脆弱 总还会有执着 人生不会只有收获 总难免有伤口 不要害怕生命中 不完美的角落 阳光在每个裂缝中散落 不如就勇敢打破生命中的裂缝 阳光就逐渐洒满了其中

[MV]-林俊杰-裂缝中的阳光——真正的牢笼在心间:《裂缝中的阳光》与穿透铁窗的灵魂救赎 [MV]-林俊杰-真正的牢笼在心间:《裂缝中的阳光》与穿透铁窗的灵魂救赎《裂缝中的阳光》是首慢板的节奏蓝调作品,由吴青峰亲自填词,林俊杰作曲、编曲兼制作 。于创作方面,这首歌没有选择林俊杰以往情歌的主题,而是将歌曲立意设定在了传递励志的正能量上。旨在提醒那些处于逆境中的人们,要拿出勇气面对心中的裂痕,不要忘记初衷,不要轻言放弃。林俊杰在演唱《裂缝中的阳光》时,感性地谈到,歌迷就是他的“裂缝中的阳光” 。该曲名为《裂缝中的阳光》,然而在每个裂缝中之所以会散落阳光,是因为阳光在每个裂缝中散落实质体现的是胶体的丁达尔效应。一、歌曲简介《裂缝中的阳光》是林俊杰演唱的节奏蓝调歌曲,由吴青峰填词,林俊杰谱曲,收录于林俊杰2013年3月13日发行的专辑《因你而在》中。《裂缝中的阳光》是首慢板的节奏蓝调作品,旨在提醒于逆境中的人们不忘初衷、不言放弃。歌词部分一字一句都在提醒每个人要拿出勇气面对心中的裂痕,不要害怕面对心中怀疑、自我挫败的声响。而林俊杰在演唱《裂缝中的阳光》时也感性地称,歌迷就是他的“裂缝中的阳光” 。2013年4月25日,林俊杰于2012年度中国TOP排行榜颁奖晚会中演唱了歌曲。二、MV欣赏{dplayer src="https://www.vvars.com/tools/mv/MV-JJLin-lfzdyg.webm"/}三、解读感悟耳机里,林俊杰的声线像一道温热的血流,注入冰冷僵硬的躯体。那句“心脏没有那么脆弱,总还会有执着”,在铁窗回音壁间反复碰撞后,最终锤击在灵魂最深处——原来,裂痕最深之处,恰是光最决意刺入之地。这首歌的疗愈力量,在监狱的布景下,展现出更锋利、也更普世的救赎意义。歌曲的诞生饱含深意。林俊杰目睹亲友与抑郁症(内心的牢笼)抗争的经历,催生了他创作此曲的冲动。他想告诉身处黑暗的人们:即使被有形或无形的枷锁困住,你灵魂深处不屈的回响,总会被听见。MV极具象化地选择了监狱——人类社会最极端的物理禁锢符号——来承载这个隐喻,直指核心:我们每个人心中,都可能囚禁着一个渴望自由却不得其门的囚徒。冰冷的规训与微弱的心光:MV开篇,铁栏切割视角,灰色天光吝啬地洒在放风场。囚犯们穿着统一编号的囚服,行走在网格般切割的水泥地上——这是失去个体性的终极形态。雨水从天而降,淋湿身体,如同无法控制命运的无情冲刷。然而,当镜头拉近特写,我们看到一个囚徒(主角)眼中死寂的深处,并非全然的空洞。当《裂缝中的阳光》旋律响起,他独自站在雨中,手掌伸向灰蒙天际,接住的不是雨水,仿佛是从云层裂缝中漏下的、有温度的光。琴键如何敲碎铁石?音乐如何凿通心墙?MV中极具象征意义的一幕:林俊杰身处牢房之内,专注弹奏一架黑色钢琴。音乐,这无形的、看似柔软的力量,竟成为穿透厚重砖墙与冰冷铁栏的媒介。它不是越狱的工具,而是心狱的解码器。琴键每一次落下,都在敲击着墙壁禁锢下的灵魂壁垒。那些音符如凿子,试图在心灵岩层上凿开一道细微裂缝。阳光非从物理的牢房裂缝射入(监狱的窗是铁栏,本无“玻璃裂缝”可言),而是当内心壁垒被撼动时,希望得以照进的路径。“等到黑夜翻面之后,会是新的白昼”:救赎在墙外,更在心底这不是廉价的“出狱即重生”。MV结局:主角终于刑满释放,蹒跚走出巨大的铁门。刺目的阳光瞬间将他淹没,他本能地用手挡眼,身体在自由中显得有些踉跄和恍惚——他还不习惯这被归还的光明。这一幕充满深意:身体的自由需要适应,心灵的解冻更非一蹴而就。真正的“新白昼”,不仅是物理空间的转换,更是心灵如何适应和拥抱这久违的光芒。“翻面”的不仅是黑夜,是被铁栏切割的过去视角,更是看待自己与世界的心境。重思“裂缝”与“牢笼”:我们皆在挣脱的路上MV的监狱场景赋予这首歌更凝重的现实感与普适性:可见与不可见的牢笼: 铁窗是枷锁的显性符号,但焦虑、抑郁、失败感、无望的重复……这些是更广泛存在却隐形的“心牢”。歌曲提醒我们:识别心牢的存在,是破壁的第一步。缝隙由自内而外的力量撬开: 光虽在“外”,但裂缝的生成,源于内心生出的那一点“执着”,是伸出手去触碰的意愿(如囚徒仰望雨空),是与穿透性的力量(音乐、信念、支持)产生共振的勇气。内里不松动,外光无法渗入。“出狱”后的漫长功课: 走出有形或无形的牢笼只是起点。在自由中的“踉跄”,恰恰证明了伤痕的存在与重塑之路的漫长。歌词给予的是长跑者的抚慰:光已在,你只是需要时间让瞳孔重新聚焦。这首歌的终极力量并非仅仅告诉人们光明必至。它通过监狱的极端语境,撕开一个更深刻的真相:最坚固的牢狱,往往由我们自己的恐惧、绝望或自我否定浇筑在心间。真正的“越狱”,始于承认被困,并允许哪怕一丝微光,敲打那看似坚不可摧的壁垒。灵魂裂缝初现之处,正是救赎开始蔓延的微光小径。四、歌曲歌词:有多少创伤卡在咽喉 有多少眼泪滴湿枕头 有多少你觉得不能够 被懂的痛只能沉默 有多少夜晚没有尽头 有多少的寂寞无人诉说 有多少次的梦还没做 已成空 等到黑夜翻面之后 会是新的白昼 等到海啸退去之后 只是潮起潮落 别到最后你才发觉 心里头的野兽 还没到最终就已经罢休 心脏没有那么脆弱 总还会有执着 人生不会只有收获 总难免有伤口 不要害怕生命中 不完美的角落 阳光在每个裂缝中散落 就算一切重来又怎样 让你的心在我心上跳动 每个逐渐暗下来的夜 一起走过 等到黑夜翻面之后 会是新的白昼 等到海啸退去之后 只是潮起潮落 别到最后你才发觉 心里头的野兽 还没到最终就已经罢休 心脏没有那么脆弱 总还会有执着 人生不会只有收获 总难免有伤口 不要害怕生命中 不完美的角落 阳光在每个裂缝中散落 不如就勇敢打破生命中的裂缝 阳光就逐渐洒满了其中 -

网络视频格式究极之战——选择webm还是mp4,以及mp4转换为webm的方式 WebM 和 MP4 都是流行的数字视频格式。先说结论,如果选择兼容性,MP4 是两者中更好的选择,因为它提供了跨各种平台和设备的更多兼容性,它是一种使用更广泛的格式,大多数视频播放器都支持它。如果你想创建一个针对网络使用优化的视频并且不介意牺牲一些兼容性,那么 WebM 是更好的选择。一、MP4和webm特点与差异1.1 MP4MP4,也称为 MPEG-4 Part 14,是一种遵循 ISO/IEC 标准的容器格式,用于存储音频和视频。此外,与 WebM 不同,MP4 还可以存储其他重要数据,如图像和字幕。这种格式的所有文件都以 .mp4 扩展名结尾,需要注意的是 MP4 不是一种开源文件格式。1.2 webmWebM 是谷歌于 2010 年推出的一种媒体文件格式。它是开源的并且 100% 免版税。WebM 格式的文件结构基于 Matroska 容器,这使其能够支持惊人的视频质量。从本质上讲,WebM 是专门为 Web 设计的,是 HTML5 中支持的较为突出的视频标准之一。1.1 两者的主要差别以下是 WebM 和 MP4 之间的一些主要区别,您在继续阅读之前应该记住这些区别。规格WebMMP4开发者谷歌国际标准化组织文件扩展名.webm.mp4支持的视频编解码器VP8 或 VP9H.265/HEVC、H.264、AVC支持的浏览器和平台歌剧、Chrome、火狐、资源管理器所有主要平台、设备、平台和媒体播放器支持串流专为互联网流媒体和共享而开发最适合上传视频并进行共享支持的设备手持和移动设备的支持不是很好支持所有流行的设备和浏览器、操作系统等二、桌面环境下MP4转webm的软件在 Windows 和 Mac 上将 MP4 转换为 WebM,可以选择如下软件:2.1 Blu-ray Master Video Converter UltimateVideo Converter Ultimate 是一款适用于 Windows 和 Mac 的用户友好型转换器。使用 Video Converter Ultimate,您无需安装多个应用程序即可转换各种视频格式。它配备了多种解决方案,包括 MP4、AVI、MKV、MPG、WebM 等转换器。此桌面程序支持更多音频和视频编解码器,允许您将编码器更改为 H.264、MPEG-4、H.265、AAC 等。此外,它是配置更多设置(例如分辨率、比特率、帧速率和视频质量)的好地方。单击下载按钮,亲自尝试最好的 MP4 到 WebM 转换器。1)下载并安装 Blu-ray Master Video Converter Ultimate。Windows免费下载macOS免费下载2)选择要转换的源文件启动软件并点击 添加文件 按钮从您的文件夹导入 MP4 文件。如需多次转换,请重复点击该按钮或从左上角选择“添加文件夹”选项。3)选择输出格式打开 输出格式 列表,然后选择 WebM 从“视频”选项卡中选择现有分辨率或单击“自定义配置文件”按钮创建新分辨率。从对话框中配置输出设置,完成后,单击“新建”按钮。4)保存输出文件在将 MP4 更改为 WebM 之前,请从“保存到”菜单中选择指定的文件夹。然后,单击 全部转换 按钮来处理转换。2.2 VLC Media PlayerVLC Media Player也是 MP4 转 WebM 软件,媒体播放器不仅用于视频或音频播放,还提供免费转换器。一些用户称其为隐藏的宝石,因为并非所有媒体播放器都能够转换。VLC 易于使用,但对于一些初学者来说,其高级设置可能是一个具有挑战性的工具。不过,以下是使用 VLC 媒体播放器将 MP4 转换为 WebM 的简单步骤。1) 安装vlc播放器如果您的设备上仍未安装 VLC,您可以从 VLC 官方网站获取。安装并运行该应用程序。转到 媒体 菜单并选择 转换/保存 选项。点击 添加 从“打开媒体”窗口中单击按钮并导入 MP4 文件。2) 转换webm旁边是 转变 页面,打开 轮廓 下拉菜单并选择 WebM 格式。进入目标菜单并单击浏览按钮选择位置文件夹。单击开始按钮开始将 MP4 转换为 WebM。2.3 HandbrakeHandBrake 是一款视频转码器,可以将 .mp4 转换为 .webm。虽然最初是为 DVD 翻录而设计的,但 HandBrake 已升级为适用于多种支持输入视频的多功能工具。它提供高质量的结果,但许多用户不熟悉它的导航。如果您想使用此解决方案,请按照以下演示操作。1)安装 HandBrake在计算机上下载并安装 HandBrake。在主菜单中,点击 开源 按钮并上传文件。或者,您可以将文件拖放到界面上。继续在 HandBrake 上将 MP4 转换为 WebM 的下一部分。2)选择输出格式为webm来自 输出会话 菜单,选择 WebM 格式。如果需要,您可以从 Inspector 部分编辑输出,例如 FPS、质量、比特率等。3)转换步骤3.编辑完成后,选择要存储转换文件的文件夹,然后单击 开始编码 按钮将 MP4 转换为 WebM VP8。三、在线MP4转webm网站3.1 Blu-ray Master这是 Blu-ray Master 的 Video Converter Ultimate 官方在线版本。 免费在线视频转换器 包含一个初学者友好的用户界面,仅包含转换所需的功能。但即使它是一个免费的在线工具,它也能保证与软件相同的高质量输出,为您提供高级设置以更改输出编码器、分辨率等。使用免费在线视频转换器在任何流行的浏览器上无限制地在线将 MP4 转换为 WebM。Blu-ray Master官网在线转换地址1) 访问官网访问官方网站并点击 启动免费转换器 按钮。它会要求您安装启动器以启用在线工具。完成后,再次单击相同的按钮并上传文件。2) 选择输出格式从页面底部选择输出格式。然后,继续 自定义配置文件 单击齿轮图标。3)配置输出参数并转换出现对话框时,更改分辨率、编解码器、帧速率等。单击 好的 按钮,然后单击 转换 按钮。这就是如何使用免费在线视频转换器将 MP4 转换为 WebM。这是软件版本的反映。它易于导航,无需付费,可立即提供相同的高质量结果。3.2 ZamzarZamzar 以其干净、不错的转换质量而闻名。它支持数百种文件转换,包括视频、音频和文档。确实,对于寻找最佳 MP4 到 WebM 转换器的用户来说,在线转换器是一个巨大的帮助。1) 访问官网Zamzar官网在线转换地址2) 选择要转换的文件点击 选择文件 按钮并从本地文件夹中选择要转换的文件。您还可以从下拉列表中选择其他来源,例如 Google Drive、OneDrive 和 URL。3) 选择输出格式从下一步中选择输出格式。从 视频 部分并点击 WebM。最后,点击 立即转换 按钮并等待转换完成。从 MP4 到 WebM 转换器下载文件。四、常见问题4.1 WebM 质量高吗?是的,WebM 是一种高质量的视频格式。它是一种开源、免版税的格式,通常用于在线视频流,例如 YouTube 和 Vimeo。WebM 即使在技术规格非常低的设备上也能提供高质量的播放,使其成为在线流媒体视频的理想选择。4.2 YouTube 使用 MP4 还是 WebM?YouTube 接受 MP4 和 WebM 视频格式。但 MP4 是 Youtube 视频推荐的视频格式。4.3 WebM 还是 MP4 质量更好?这取决于两种格式的使用情况。MP4 是普遍支持的,因此在网站上上传文件时,您可以选择它。但是,WebM 提供了出色的质量,而不会使文件大小过大,如果平台有限制,WebM 会更好。4.4 WebM 是有损的还是无损的?WebM 是一种有损压缩格式。

网络视频格式究极之战——选择webm还是mp4,以及mp4转换为webm的方式 WebM 和 MP4 都是流行的数字视频格式。先说结论,如果选择兼容性,MP4 是两者中更好的选择,因为它提供了跨各种平台和设备的更多兼容性,它是一种使用更广泛的格式,大多数视频播放器都支持它。如果你想创建一个针对网络使用优化的视频并且不介意牺牲一些兼容性,那么 WebM 是更好的选择。一、MP4和webm特点与差异1.1 MP4MP4,也称为 MPEG-4 Part 14,是一种遵循 ISO/IEC 标准的容器格式,用于存储音频和视频。此外,与 WebM 不同,MP4 还可以存储其他重要数据,如图像和字幕。这种格式的所有文件都以 .mp4 扩展名结尾,需要注意的是 MP4 不是一种开源文件格式。1.2 webmWebM 是谷歌于 2010 年推出的一种媒体文件格式。它是开源的并且 100% 免版税。WebM 格式的文件结构基于 Matroska 容器,这使其能够支持惊人的视频质量。从本质上讲,WebM 是专门为 Web 设计的,是 HTML5 中支持的较为突出的视频标准之一。1.1 两者的主要差别以下是 WebM 和 MP4 之间的一些主要区别,您在继续阅读之前应该记住这些区别。规格WebMMP4开发者谷歌国际标准化组织文件扩展名.webm.mp4支持的视频编解码器VP8 或 VP9H.265/HEVC、H.264、AVC支持的浏览器和平台歌剧、Chrome、火狐、资源管理器所有主要平台、设备、平台和媒体播放器支持串流专为互联网流媒体和共享而开发最适合上传视频并进行共享支持的设备手持和移动设备的支持不是很好支持所有流行的设备和浏览器、操作系统等二、桌面环境下MP4转webm的软件在 Windows 和 Mac 上将 MP4 转换为 WebM,可以选择如下软件:2.1 Blu-ray Master Video Converter UltimateVideo Converter Ultimate 是一款适用于 Windows 和 Mac 的用户友好型转换器。使用 Video Converter Ultimate,您无需安装多个应用程序即可转换各种视频格式。它配备了多种解决方案,包括 MP4、AVI、MKV、MPG、WebM 等转换器。此桌面程序支持更多音频和视频编解码器,允许您将编码器更改为 H.264、MPEG-4、H.265、AAC 等。此外,它是配置更多设置(例如分辨率、比特率、帧速率和视频质量)的好地方。单击下载按钮,亲自尝试最好的 MP4 到 WebM 转换器。1)下载并安装 Blu-ray Master Video Converter Ultimate。Windows免费下载macOS免费下载2)选择要转换的源文件启动软件并点击 添加文件 按钮从您的文件夹导入 MP4 文件。如需多次转换,请重复点击该按钮或从左上角选择“添加文件夹”选项。3)选择输出格式打开 输出格式 列表,然后选择 WebM 从“视频”选项卡中选择现有分辨率或单击“自定义配置文件”按钮创建新分辨率。从对话框中配置输出设置,完成后,单击“新建”按钮。4)保存输出文件在将 MP4 更改为 WebM 之前,请从“保存到”菜单中选择指定的文件夹。然后,单击 全部转换 按钮来处理转换。2.2 VLC Media PlayerVLC Media Player也是 MP4 转 WebM 软件,媒体播放器不仅用于视频或音频播放,还提供免费转换器。一些用户称其为隐藏的宝石,因为并非所有媒体播放器都能够转换。VLC 易于使用,但对于一些初学者来说,其高级设置可能是一个具有挑战性的工具。不过,以下是使用 VLC 媒体播放器将 MP4 转换为 WebM 的简单步骤。1) 安装vlc播放器如果您的设备上仍未安装 VLC,您可以从 VLC 官方网站获取。安装并运行该应用程序。转到 媒体 菜单并选择 转换/保存 选项。点击 添加 从“打开媒体”窗口中单击按钮并导入 MP4 文件。2) 转换webm旁边是 转变 页面,打开 轮廓 下拉菜单并选择 WebM 格式。进入目标菜单并单击浏览按钮选择位置文件夹。单击开始按钮开始将 MP4 转换为 WebM。2.3 HandbrakeHandBrake 是一款视频转码器,可以将 .mp4 转换为 .webm。虽然最初是为 DVD 翻录而设计的,但 HandBrake 已升级为适用于多种支持输入视频的多功能工具。它提供高质量的结果,但许多用户不熟悉它的导航。如果您想使用此解决方案,请按照以下演示操作。1)安装 HandBrake在计算机上下载并安装 HandBrake。在主菜单中,点击 开源 按钮并上传文件。或者,您可以将文件拖放到界面上。继续在 HandBrake 上将 MP4 转换为 WebM 的下一部分。2)选择输出格式为webm来自 输出会话 菜单,选择 WebM 格式。如果需要,您可以从 Inspector 部分编辑输出,例如 FPS、质量、比特率等。3)转换步骤3.编辑完成后,选择要存储转换文件的文件夹,然后单击 开始编码 按钮将 MP4 转换为 WebM VP8。三、在线MP4转webm网站3.1 Blu-ray Master这是 Blu-ray Master 的 Video Converter Ultimate 官方在线版本。 免费在线视频转换器 包含一个初学者友好的用户界面,仅包含转换所需的功能。但即使它是一个免费的在线工具,它也能保证与软件相同的高质量输出,为您提供高级设置以更改输出编码器、分辨率等。使用免费在线视频转换器在任何流行的浏览器上无限制地在线将 MP4 转换为 WebM。Blu-ray Master官网在线转换地址1) 访问官网访问官方网站并点击 启动免费转换器 按钮。它会要求您安装启动器以启用在线工具。完成后,再次单击相同的按钮并上传文件。2) 选择输出格式从页面底部选择输出格式。然后,继续 自定义配置文件 单击齿轮图标。3)配置输出参数并转换出现对话框时,更改分辨率、编解码器、帧速率等。单击 好的 按钮,然后单击 转换 按钮。这就是如何使用免费在线视频转换器将 MP4 转换为 WebM。这是软件版本的反映。它易于导航,无需付费,可立即提供相同的高质量结果。3.2 ZamzarZamzar 以其干净、不错的转换质量而闻名。它支持数百种文件转换,包括视频、音频和文档。确实,对于寻找最佳 MP4 到 WebM 转换器的用户来说,在线转换器是一个巨大的帮助。1) 访问官网Zamzar官网在线转换地址2) 选择要转换的文件点击 选择文件 按钮并从本地文件夹中选择要转换的文件。您还可以从下拉列表中选择其他来源,例如 Google Drive、OneDrive 和 URL。3) 选择输出格式从下一步中选择输出格式。从 视频 部分并点击 WebM。最后,点击 立即转换 按钮并等待转换完成。从 MP4 到 WebM 转换器下载文件。四、常见问题4.1 WebM 质量高吗?是的,WebM 是一种高质量的视频格式。它是一种开源、免版税的格式,通常用于在线视频流,例如 YouTube 和 Vimeo。WebM 即使在技术规格非常低的设备上也能提供高质量的播放,使其成为在线流媒体视频的理想选择。4.2 YouTube 使用 MP4 还是 WebM?YouTube 接受 MP4 和 WebM 视频格式。但 MP4 是 Youtube 视频推荐的视频格式。4.3 WebM 还是 MP4 质量更好?这取决于两种格式的使用情况。MP4 是普遍支持的,因此在网站上上传文件时,您可以选择它。但是,WebM 提供了出色的质量,而不会使文件大小过大,如果平台有限制,WebM 会更好。4.4 WebM 是有损的还是无损的?WebM 是一种有损压缩格式。

![[MV]-林俊杰-裂缝中的阳光——真正的牢笼在心间:《裂缝中的阳光》与穿透铁窗的灵魂救赎](https://www.vvars.com/img/i/2025/06/06/1749223363.webp)